TL;DR: Az Adatfeldolgozó AI Ügynökök Forradalma a Kvantum-Klasszikus Hibrid Érában

A technológiai világ figyelme ismét az NVIDIA felé fordult, amikor a vállalat a napokban leleplezte legújabb innovációját: az Ising-7B, Ising-30B és az Ising-MoE (Mixture of Experts) mesterséges intelligencia modelleket. Ezek a modellek nem csupán a hagyományos nyelvi feldolgozást célozzák, hanem kifejezetten a kvantum-klasszikus hibrid rendszerek, és ezen belül is a CUDA-Q platform kiszolgálására épültek. A bejelentés alapjaiban rajzolja át azt, amit az adatfeldolgozó AI-ügynökök képességeiről eddig gondoltunk.

A kvantumszámítástechnika évtizedek óta a jövő ígérete, de a fizikai qubitek instabilitása és a dekoherencia eddig gátat szabott a széles körű ipari alkalmazásnak. Az NVIDIA új modelljei ezt a problémát célozzák meg úgy, hogy intelligens, autonóm ügynököket vetnek be a kvantumhibajavítás (Quantum Error Correction - QEC) valós idejű menedzselésére. Ezek az ügynökök a klasszikus GPU-kon futva, mikroszekundumok alatt dolgozzák fel a kvantumprocesszorokból (QPU) érkező szindróma-adatokat.

Ez a cikk mélyrehatóan elemzi ezt a paradigmaváltást. Megvizsgáljuk, hogyan működnek ezek a hibrid architektúrák, és miért elengedhetetlenek a modern vállalati infrastruktúrák számára. Feltárjuk az Ising modellek technikai hátterét, a megerősítéses tanulás szerepét, és azt, hogy a CTO-k hogyan kezdhetik meg a felkészülést erre az új érára.

Bevezetés: Az Adatrobbanás és a Kvantum-Klasszikus Szintézis Kora

Az elmúlt évtizedet a soha nem látott mértékű adatrobbanás jellemezte. A vállalatok naponta petabájtokban mérhető információt generálnak, a szenzoradatoktól kezdve a pénzügyi tranzakciókig. A klasszikus Neumann-architektúrára épülő számítógépek, bár elképesztő fejlődésen mentek keresztül, egyre közelebb kerülnek fizikai és termodinamikai határaikhoz. A Moore-törvény lassulása egyértelművé tette: új számítási paradigmára van szükség a komplexitás kezeléséhez.

A kvantumszámítógépek elméletben exponenciális sebességnövekedést kínálnak bizonyos problémák, például a prímfelbontás vagy a molekuláris szimulációk terén. Azonban a jelenlegi, úgynevezett NISQ (Noisy Intermediate-Scale Quantum) korszakban a kvantumgépek rendkívül zajosak és hajlamosak a hibákra. Itt lép be a képbe a kvantum-klasszikus hibrid szintézis, amely a két világ legjobb tulajdonságait ötvözi.

Problémafelvetés: A Komplexitás Korlátja

A klasszikus rendszerek nem képesek elég gyorsan szimulálni a kvantumállapotokat, míg a kvantumrendszerek önmagukban túl instabilak a megbízható adatfeldolgozáshoz. A kihívás egy olyan intelligens közvetítő réteg létrehozása, amely valós időben képes értelmezni, javítani és optimalizálni a két rendszer közötti adatáramlást, anélkül, hogy a késleltetés (latency) tönkretenné a kvantumállapotot.

Ebben a hibrid környezetben a hagyományos szoftveres megoldások már nem elegendőek. Olyan autonóm entitásokra van szükség, amelyek képesek adaptívan reagálni a másodperc töredéke alatt bekövetkező változásokra. Ezek az entitások a fejlett adatfeldolgozó AI ügynökök, amelyek a klasszikus hardvereken (például NVIDIA H100 vagy B200 GPU-kon) futva irányítják a kvantumfolyamatokat. Ahogyan azt az AI infrastruktúra verseny is mutatja, a hardver és a szoftver egyre szorosabban fonódik össze.

Ezek az ügynökök nem csupán passzív adatfeldolgozók. Képesek prediktív modellezésre, anomáliadetektálásra és a kvantumáramkörök dinamikus újraprogramozására. A klasszikus és kvantum processzorok közötti szinergia megteremtése a következő évtized legfontosabb technológiai kihívása, amely alapjaiban határozza meg a globális gazdaság versenyképességét.

Mi az Adatfeldolgozó AI Ügynök? Egy Új Paradigmaváltás a Kvantum-Klasszikus Hibrid Rendszerekben

A hagyományos mesterséges intelligencia modellek, mint például a korai nagy nyelvi modellek (LLM-ek), jellemzően statikus adatkészleteken tanultak, és kérés-válasz alapon működtek. Ezzel szemben egy adatfeldolgozó AI ügynök egy autonóm, célvezérelt szoftveres entitás, amely folyamatosan érzékeli a környezetét, döntéseket hoz, és beavatkozik. A kvantum-klasszikus hibrid rendszerek kontextusában ez a környezet egy rendkívül zajos, magas dimenziójú adatteret jelent.

Definíció: Kvantum-Hibrid Adatfeldolgozó AI Ügynök

Olyan autonóm mesterséges intelligencia rendszer, amely klasszikus gyorsítókon (GPU/TPU) futva valós időben dolgozza fel a kvantumprocesszorokból származó mérési adatokat. Képes önállóan optimalizálni a kvantumalgoritmusokat, végrehajtani a hibajavítási protokollokat, és a kvantumkimeneteket a klasszikus vállalati rendszerek számára értelmezhető formátummá alakítani.

Ezek az ügynökök több kulcsfontosságú tulajdonsággal rendelkeznek, amelyek megkülönböztetik őket a hagyományos adatfeldolgozó szkriptektől. Először is, rendelkeznek 'állapottal' (state) és memóriával, ami lehetővé teszi számukra, hogy tanuljanak a korábbi kvantumfuttatások hibáiból. Másodszor, képesek az egyedi automatizálás révén dinamikusan módosítani a saját adatfeldolgozási pipeline-jukat a bejövő adatok minőségének függvényében.

A kvantumalgoritmusok, mint például a VQE (Variational Quantum Eigensolver) vagy a QAOA (Quantum Approximate Optimization Algorithm), folyamatos iterációt igényelnek a kvantum és klasszikus hardver között. Az AI ügynök feladata, hogy a klasszikus oldalon futó optimalizációs lépéseket a lehető leggyorsabban és legpontosabban végezze el. Ehhez olyan mélytanulási technikákat alkalmaznak, amelyek képesek a hatalmas paraméterterekben is megtalálni a globális optimumot.

Továbbá, ezek az ügynökök felelősek a dekoherencia elleni harcért. A kvantumállapotok rendkívül törékenyek; a környezeti zaj hatására az információ gyorsan elvész. Az ügynököknek a másodperc milliomod része alatt kell elemezniük a szindróma-méréseket, és visszaküldeniük a korrekciós jeleket a QPU-nak. Ez a sebesség és intelligencia az, ami a kvantum-hibrid rendszereket egyáltalán működőképessé teszi a gyakorlatban.

Az NVIDIA Ising Modellek: A Kvantum AI Ügynökök Motorjai és a CUDA-Q Platform

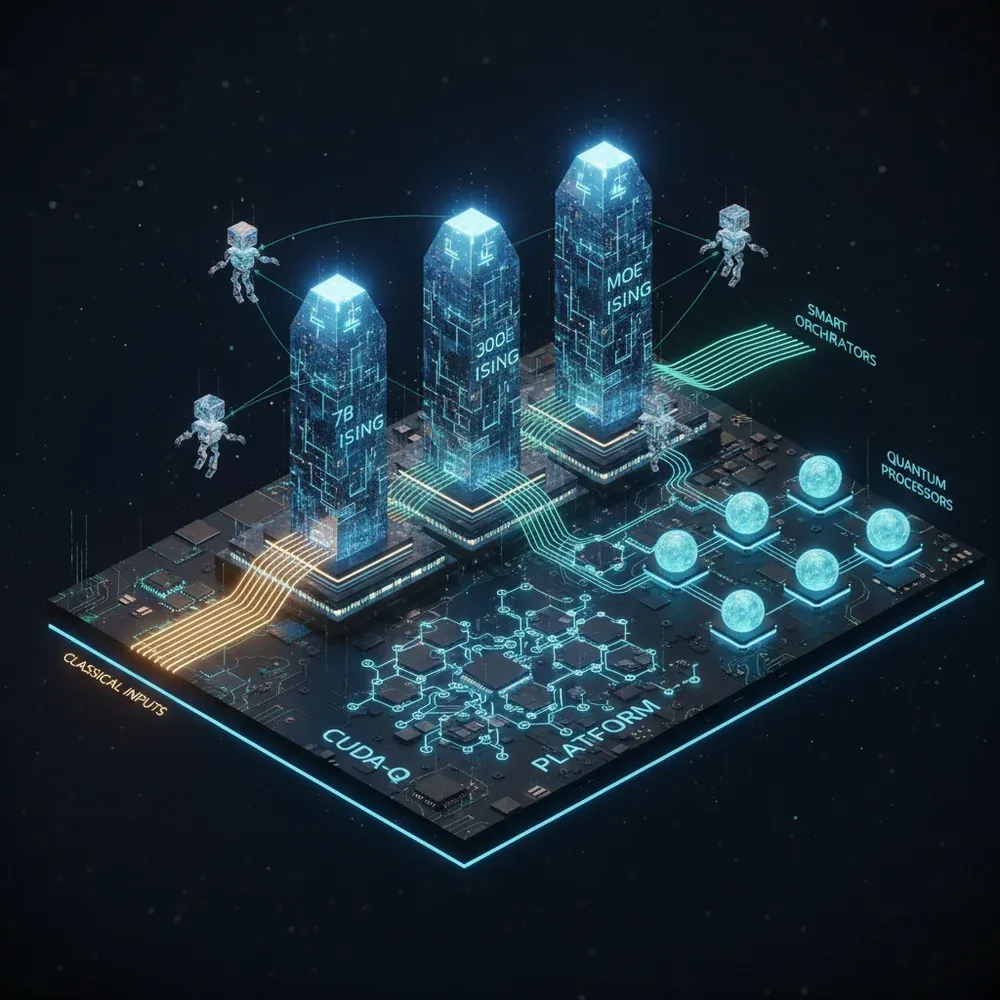

Az NVIDIA legújabb bejelentése, az Ising modellcsalád (Ising-7B, Ising-30B és Ising-MoE) egyértelművé tette, hogy a vállalat nem csupán a hardver, hanem a kvantumszoftver piacát is uralni kívánja. Ezek a modellek nevüket a statisztikus mechanikából ismert Ising-modellről kapták, amely a ferromágnesesség matematikai leírására szolgál, és a kvantum-optimalizációs problémák alapját képezi. Az Ising modellek architektúráját kifejezetten arra tervezték, hogy a QUBO (Quadratic Unconstrained Binary Optimization) problémákat natívan, AI-vezérelt módon oldják meg.

Az Ising-7B egy rendkívül gyors, alacsony késleltetésű modell, amelyet az edge-computing környezetekre és a közvetlenül a QPU mellett elhelyezett vezérlőelektronikára optimalizáltak. Feladata a gyors, valós idejű döntéshozatal a kvantumhibajavító hurkokban. Ezzel szemben az Ising-30B a mélyebb, komplexebb adatelemzési feladatokért felel, mint például a kvantumállapot-tomográfia és a zajmodellezés.

A legizgalmasabb fejlesztés azonban az Ising-MoE (Mixture of Experts) modell. Ez az architektúra több specializált neurális hálózatot (szakértőt) tartalmaz, amelyeket egy kapuzó hálózat (gating network) irányít. A kvantumadatok feldolgozása során a modell dinamikusan választja ki az adott zajtípushoz vagy algoritmushoz leginkább értő szakértőt. Ez drasztikusan csökkenti a számítási költségeket, miközben növeli a pontosságot, ami kritikus a hibatűrő (fault-tolerant) kvantumszámítástechnika eléréséhez.

Kulcstechnológia: CUDA-Q Integráció

A CUDA-Q (korábban cuQuantum) az NVIDIA nyílt forráskódú platformja a hibrid kvantum-klasszikus programozáshoz. Az Ising modellek natívan integrálódnak ebbe a környezetbe, lehetővé téve a fejlesztők számára, hogy C++ vagy Python nyelven írt kódjukból közvetlenül hívják meg az AI ügynököket. Ez a szoros integráció minimalizálja az adatmozgatásból eredő késleltetést a CPU, GPU és QPU között.

Az Ising modellek betanítása során az NVIDIA hatalmas mennyiségű szimulált kvantumzaj-adatot használt fel, amelyet a saját DGX Quantum rendszerein generált. Ez a proaktív megközelítés biztosítja, hogy az AI ügynökök már az első naptól kezdve képesek legyenek kezelni a valós fizikai kvantumprocesszorok anomáliáit. Ahogy a jövőbeni enterprise rendszerek egyre inkább hibriddé válnak, az Ising modellek jelentik majd a hidat a klasszikus adatközpontok és a kvantum-koprocesszorok között.

A Kvantum-Klasszikus Hibrid Számítástechnika: Elmélet, Gyakorlat és az Ügynökök Szerepe

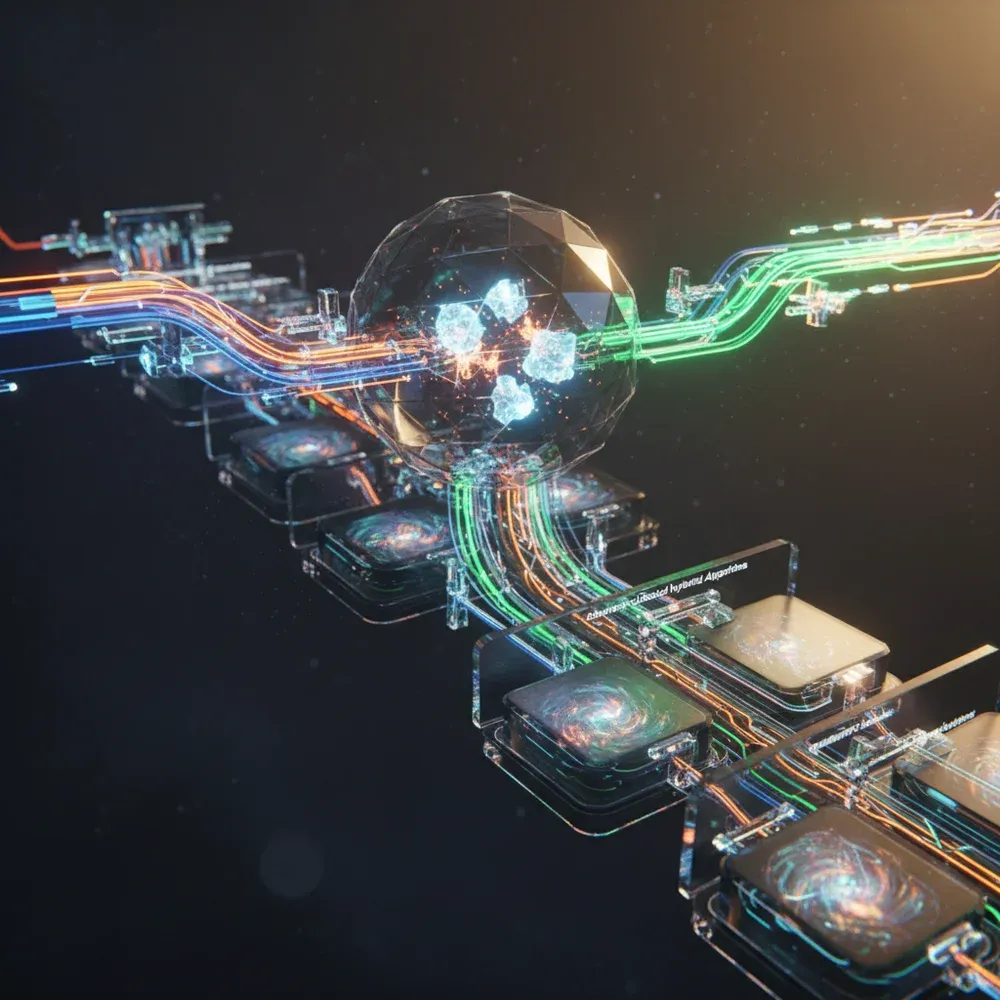

A kvantum-klasszikus hibrid számítástechnika nem csupán egy átmeneti fázis a teljesen hibatűrő kvantumszámítógépek eljöveteléig; sok szakértő szerint ez a végleges, legoptimálisabb architektúra. Ennek oka, hogy a kvantumprocesszorok kiválóak bizonyos specifikus feladatokban (pl. szuperpozíció és összefonódás kiaknázása), de rendkívül rosszak a hagyományos adatmozgatásban, I/O műveletekben és egyszerű aritmetikában. A klasszikus processzorok (CPU-k, GPU-k) pont ezekben a feladatokban jeleskednek.

A hibrid modell lényege a feladatok intelligens delegálása. Egy komplex probléma, például egy új gyógyszermolekula szimulációja, felbomlik klasszikus és kvantum részekre. A klasszikus gép előkészíti az adatokat, beállítja a kvantumáramkör paramétereit, és elküldi a feladatot a QPU-nak. A QPU végrehajtja a kvantumműveleteket, majd a mérési eredményeket visszaküldi a klasszikus gépnek, amely frissíti a paramétereket és újabb iterációt indít.

Ebben a folyamatban az adatfeldolgozó AI ügynökök töltik be a karmester szerepét. Ők azok az intelligens szoftverkomponensek, amelyek átlátják a teljes architektúrát. Az ügynökök döntik el, hogy egy adott számítási feladatot érdemes-e a zajos kvantumhardverre küldeni, vagy gyorsabb és olcsóbb egy klasszikus GPU-n emulálni azt. Ezt a döntést valós időben, a rendelkezésre álló erőforrások, a hálózati terheltség és a kvantumgép aktuális zajszintje alapján hozzák meg.

Továbbá, az ügynökök felelnek az eredmények értelmezéséért is. A kvantummérések kimenete gyakran valószínűségi eloszlások formájában jelenik meg. Az AI ügynökök statisztikai modelleket és gépi tanulási algoritmusokat használnak ezen eloszlások elemzésére, kiszűrve a zajt és kinyerve a hasznos információt. Ez a folyamat elengedhetetlen ahhoz, hogy a kvantumszámítástechnika valódi üzleti értéket teremtsen a vállalatok számára.

Megerősítéses Tanulás (RL) a Kvantumhibajavításban: Az Ügynökök Intelligenciája

A kvantumhibajavítás (QEC) a kvantumszámítástechnika Szent Grálja. A fizikai qubitek rendkívül érzékenyek a környezeti hatásokra, mint például a hőmérséklet-ingadozás vagy az elektromágneses sugárzás. A QEC protokollok, mint például a Surface Code, logikai qubiteket hoznak létre több fizikai qubit összefonásával, így védve az információt. Azonban a hibák detektálása és javítása valós időben, a dekoherenciai időn (amely gyakran csak néhány mikroszekundum) belül, óriási számítási kihívás.

Itt lép be a képbe a megerősítéses tanulás (Reinforcement Learning - RL). Az NVIDIA Ising modelljei RL algoritmusokat használnak a QEC stratégiák autonóm elsajátítására. Az AI ügynök egy 'játékosként' működik, amelynek célja a kvantumállapot stabilitásának maximalizálása. A környezet a zajos kvantumprocesszor, az állapot a szindróma-mérések eredménye, az akció pedig a korrekciós kapuk alkalmazása.

Az ügynök folyamatosan interakcióba lép a környezettel, és jutalmat (reward) kap, ha sikeresen megőrzi a kvantumállapotot, illetve büntetést, ha az információ elvész. Idővel az ügynök olyan komplex, nem-lineáris hibajavítási stratégiákat fedez fel, amelyeket az emberi kutatók képtelenek lennének manuálisan megtervezni. Különösen a korrelált hibák (amikor egyetlen zajforrás több qubitet is érint) kezelésében mutatnak az RL-alapú ügynökök drasztikus teljesítménynövekedést a hagyományos dekódoló algoritmusokhoz (pl. Minimum Weight Perfect Matching) képest.

Ez az autonóm tanulási képesség teszi az adatfeldolgozó AI ügynököket nélkülözhetetlenné a skálázható kvantumszámítógépek építésében. Ha az Ön vállalata is szeretné kiaknázni az AI-vezérelt optimalizáció előnyeit, érdemes megfontolni az egyedi automatizálás lehetőségeit, amelyek már ma is elérhetőek a klasszikus rendszerekben.

Extrém Komplexitású Logisztikai Optimalizáció: Esettanulmányok és Lehetőségek

A kvantum-klasszikus hibrid rendszerek és az azokat irányító AI ügynökök egyik legígéretesebb alkalmazási területe a kombinatorikus optimalizáció. A globális logisztikai láncok, a flottamenedzsment és a raktározási folyamatok olyan mértékű komplexitást értek el, amelyet a klasszikus algoritmusok (mint például a szimplex módszer vagy a heurisztikák) már csak kompromisszumokkal képesek kezelni. Az utazó ügynök probléma (TSP) vagy a járműútvonal-tervezési probléma (VRP) exponenciálisan nehezedik a változók számának növekedésével.

Az adatfeldolgozó AI ügynökök képesek ezeket a logisztikai kihívásokat QUBO formátumra fordítani, majd a kvantum-koprocesszorokat használva másodpercek alatt megtalálni a közel optimális megoldásokat. Egy globális szállítmányozási vállalat esetében például az ügynök valós időben elemzi az időjárási adatokat, a forgalmi információkat, a kikötői kapacitásokat és a hajók üzemanyag-fogyasztását. A hibrid rendszer képes dinamikusan újratervezni több ezer konténer útvonalát egy váratlan esemény (pl. a Szuezi-csatorna lezárása) esetén, minimalizálva a késéseket és a költségeket.

A pénzügyi szektorban a portfólió-optimalizálás és a kockázatelemzés (pl. Monte Carlo szimulációk) terén hozhatnak áttörést ezek a technológiák. Az AI ügynökök a kvantumalgoritmusok segítségével sokkal pontosabban képesek modellezni a piaci volatilitást és a korrelációkat a különböző eszközosztályok között. A gyógyszeriparban pedig a molekuláris dokkolás és a fehérjehajtogatás szimulációja gyorsulhat fel drasztikusan, lerövidítve az új gyógyszerek piacra dobásának idejét.

Ezek az esettanulmányok jól mutatják, hogy a kvantum AI nem csupán egy elméleti kutatási terület, hanem a közeljövő legfontosabb üzleti fegyvere. Azok a vállalatok, amelyek időben integrálják a fejlett adatfeldolgozó AI-ügynököket, behozhatatlan versenyelőnyre tesznek szert a piacon.

Az Adatfeldolgozás Mélységei: Milyen Adatokkal Dolgoznak az AI Ügynökök?

A kvantum-klasszikus hibrid rendszerekben működő AI ügynökök adatfeldolgozási feladatai rendkívül sokrétűek és komplexek. Nem csupán a hagyományos, strukturált relációs adatbázisokkal kell megbirkózniuk, hanem olyan adattípusokkal is, amelyek a klasszikus IT infrastruktúrák számára teljesen idegenek. A sikeres működés alapja egy robusztus, rendkívül alacsony késleltetésű adatpipeline (data pipeline) kiépítése.

Először is, az ügynököknek kezelniük kell a klasszikus vállalati adatokat: ERP rendszerekből származó logisztikai információkat, pénzügyi tranzakciókat, vagy éppen IoT szenzorok valós idejű telemetriai adatait. Ezeket az adatokat az ügynökök megtisztítják, normalizálják, és olyan formátumba öntik, amely alkalmas a kvantumalgoritmusok paraméterezésére. Ez a folyamat önmagában is fejlett gépi tanulási modelleket igényel az anomáliák kiszűrésére és a hiányzó adatok imputálására.

A második, sokkal kritikusabb adattípus a kvantum hardverből származó mérési adat. A kvantumállapotok mérése során kapott eredmények zajosak és statisztikai jellegűek. Az AI ügynököknek hatalmas mennyiségű (gyakran gigabyte/másodperc nagyságrendű) szindróma-adatot kell feldolgozniuk a hibajavításhoz. Ezek az adatok nem tárolhatók hagyományos merevlemezeken; a feldolgozásnak közvetlenül a GPU memóriájában (VRAM), vagy akár a hálózati kártyákon (DPU) kell megtörténnie a késleltetés minimalizálása érdekében.

Végül, az ügynökök szimulációs adatokkal is dolgoznak. A kvantumalgoritmusok futtatása előtt gyakran klasszikus emulátorokon (mint a CUDA-Q) tesztelik a paramétereket. Az AI ügynök összehasonlítja a szimulált eredményeket a valós kvantum hardver kimenetével, és ez alapján finomhangolja a zajmodelleket. Ez a folyamatos tanulási hurok biztosítja, hogy a rendszer egyre pontosabb és megbízhatóbb legyen az idő előrehaladtával.

Kihívások és Jövőbeli Irányok: Az Adatfeldolgozó AI Ügynökök Útja a Teljes Potenciál Felé

Bár az NVIDIA Ising modelljei és a CUDA-Q platform hatalmas ugrást jelentenek, az adatfeldolgozó AI ügynökök kvantum-hibrid környezetben történő alkalmazása még mindig számos kihívással néz szembe. A legjelentősebb akadály továbbra is a hardveres korlátokban keresendő. A jelenlegi kvantumprocesszorok qubitszáma és koherenciaideje még mindig alacsony a valódi, nagyléptékű ipari problémák megoldásához. Bár az AI ügynökök képesek enyhíteni ezeket a hiányosságokat a fejlett hibajavítással, a fizikai korlátokat nem tudják teljesen áthidalni.

Egy másik komoly kihívás az adatátviteli sávszélesség és a késleltetés. A kvantumprocesszorok jellemzően kriogenikus környezetben (milliKelvin hőmérsékleten) működnek, míg a klasszikus GPU-k szobahőmérsékleten. A két rendszer közötti kábelezés és jelfeldolgozás mikroszekundumos késleltetéseket okoz, ami kritikus lehet a valós idejű hibajavítás során. A jövőbeli irányok között szerepel a fotonikus összeköttetések és a kriogenikus környezetben működő klasszikus vezérlőchipek fejlesztése.

Az AI modellek interpretálhatósága (magyarázhatósága) szintén kritikus kérdés, különösen a szabályozott iparágakban, mint a pénzügy vagy az egészségügy. Ha egy AI ügynök egy komplex RL algoritmus alapján hoz meg egy optimalizációs döntést, a vállalatoknak tudniuk kell, hogy miért született az adott eredmény. A 'fekete doboz' (black box) modellek elfogadottsága alacsony, ezért a kutatók gőzerővel dolgoznak a magyarázható AI (XAI) technikák integrálásán a kvantum-hibrid rendszerekbe.

Végül, a szakemberhiány is jelentős gátló tényező. Olyan mérnökökre van szükség, akik egyaránt értenek a kvantumfizikához, a gépi tanuláshoz és a nagy teljesítményű számítástechnikához (HPC). Az oktatási rendszereknek és a vállalati képzéseknek gyorsan kell adaptálódniuk ehhez az új interdiszciplináris területhez, hogy biztosítsák a jövőbeli innovációhoz szükséges tehetségeket.

Implementációs Stratégiák Vállalati Környezetben: Hogyan Kezdjünk Hozzá?

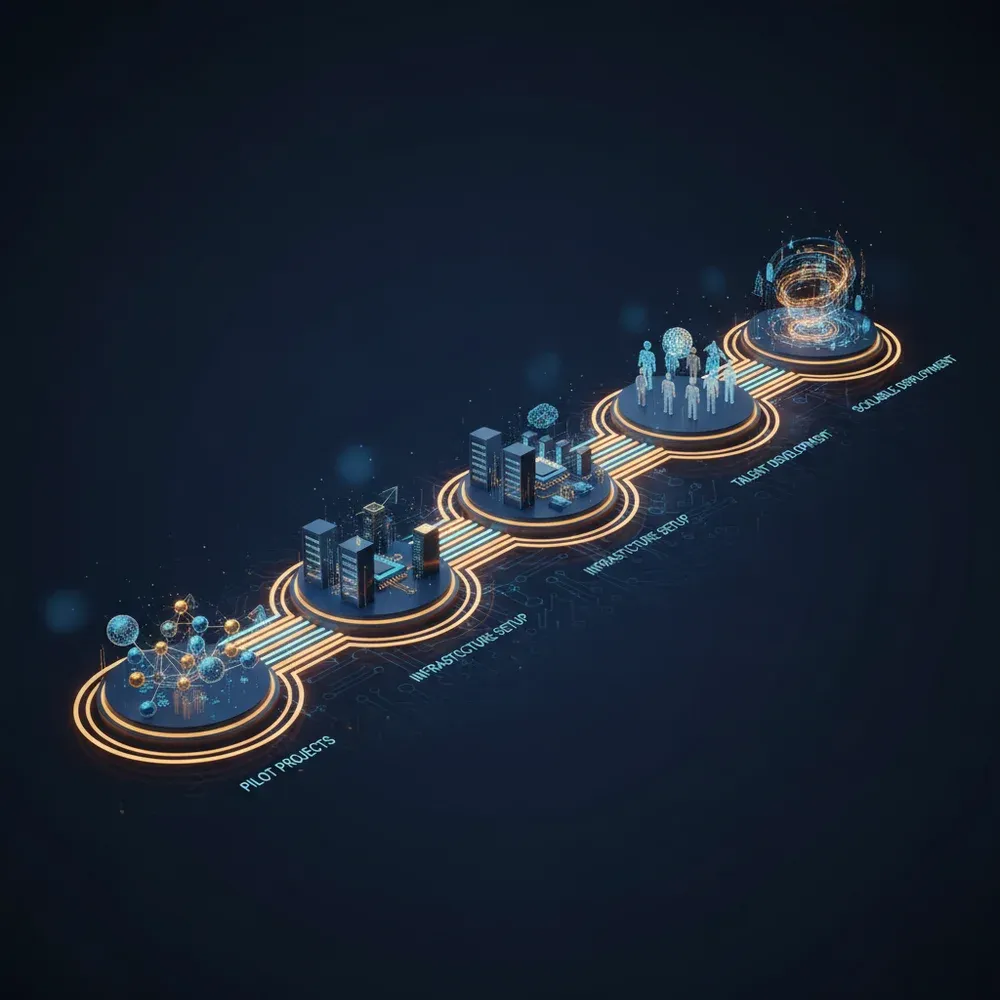

A CTO-k és vállalati architektek számára a legfontosabb kérdés nem az, hogy a kvantum-hibrid technológia megváltoztatja-e az iparágat, hanem az, hogy mikor és hogyan érdemes elkezdeni az integrációt. A várakozás stratégiája kockázatos; azok a cégek, amelyek csak a teljesen érett, hibatűrő kvantumgépekre várnak, behozhatatlan hátrányba kerülhetnek a korai adaptálókkal szemben. A kulcs a fokozatos, értékvezérelt implementáció.

Az első lépés a kvantum-készség (quantum readiness) felmérése. A vállalatoknak azonosítaniuk kell azokat a szűk keresztmetszeteket a jelenlegi adatfeldolgozási és optimalizációs folyamataikban, amelyeket a klasszikus rendszerek már nem tudnak hatékonyan kezelni. Ezek lesznek a potenciális 'Proof of Concept' (PoC) projektek célpontjai. Érdemes olyan problémákat választani, amelyek matematikai struktúrája (pl. QUBO) jól illeszkedik a kvantum-hibrid megoldásokhoz.

A második lépés a megfelelő infrastruktúra és szoftverkörnyezet kialakítása. Nem szükséges azonnal saját kvantumhardvert vásárolni; a felhőszolgáltatók (AWS Braket, Azure Quantum) és az NVIDIA CUDA-Q platformja kiváló lehetőséget biztosítanak a szimulációra és a hibrid kódok fejlesztésére. A vállalatok elkezdhetik betanítani a saját adatfeldolgozó AI ügynökeiket ezeken a szimulált környezeteken, felkészítve őket a valós kvantum hardverekkel való jövőbeli interakcióra.

Harmadszor, a tehetséggondozás és a partnerkapcsolatok építése elengedhetetlen. A vállalatoknak érdemes együttműködniük kutatóintézetekkel, kvantum startupokkal és olyan specializált AI integrátorokkal, mint az AiSolve. Ha szeretné megtenni az első lépéseket az intelligens rendszerek felé, egy AI Chatbot vagy egy egyedi automatizálási projekt kiváló kiindulópont lehet a vállalati AI kultúra megalapozásához.

A Kvantum AI Jövője: Mit Mondanak a Szakértők és az NVIDIA?

A kvantum-klasszikus hibrid rendszerek és az AI ügynökök konvergenciája a technológiai iparág legmeghatározóbb trendjévé válik a 2020-as évek végére. Az NVIDIA vezérigazgatója, Jensen Huang többször is hangsúlyozta, hogy a mesterséges intelligencia és a kvantumszámítástechnika nem két különálló terület, hanem ugyanannak az éremnek a két oldala. Az Ising modellek bemutatása is ezt a víziót támasztja alá: az AI szükséges a kvantumgépek működtetéséhez, a kvantumgépek pedig szükségesek az AI következő generációjának betanításához.

Szakértők, köztük a vezető egyetemek (MIT, Stanford) kvantuminformatikai kutatói egyetértenek abban, hogy a hibrid megközelítés az egyetlen járható út a belátható jövőben. A kvantum AI áttörések azt mutatják, hogy a gépi tanulás képes áthidalni azokat a fizikai korlátokat, amelyeket a hardvermérnökök csak évtizedek múlva tudnának megoldani. Az autonóm adatfeldolgozó ügynökök szerepe felértékelődik, ahogy a rendszerek komplexitása meghaladja az emberi megértés határait.

A jövőben arra számíthatunk, hogy a kvantum-koprocesszorok ugyanolyan elterjedtté válnak az adatközpontokban, mint ma a GPU-k. A szoftverfejlesztők számára a kvantum-klasszikus hibrid programozás egy alapvető készséggé válik, a CUDA-Q és a hasonló keretrendszerek pedig a mindennapi eszköztár részét képezik majd. Azok a vállalatok, amelyek ma befektetnek ezekbe a technológiákba, a holnap iparági vezetőivé válnak.

Következtetés: Készen Áll Vállalata a Kvantum-Hibrid Forradalomra?

Összegezve, az NVIDIA Ising modelljeinek és a CUDA-Q platformnak a megjelenése nem csupán egy újabb technológiai mérföldkő, hanem egy új korszak kezdete az adatfeldolgozásban. A kvantum-klasszikus hibrid rendszerek és az azokat irányító autonóm AI ügynökök soha nem látott lehetőségeket kínálnak a komplex problémák megoldására, a logisztikától kezdve a gyógyszerkutatásig. Ezek a rendszerek képesek valós időben kezelni a kvantumhibajavítást, optimalizálni az erőforrásokat, és hidat képezni a klasszikus vállalati IT és a jövő kvantum hardverei között.

A paradigmaváltás már elkezdődött. Az adatrobbanás és a klasszikus számítástechnika korlátai kikényszerítik az innovációt. A vállalatok számára a kérdés nem az, hogy adaptálják-e ezeket a technológiákat, hanem az, hogy mikor. A korai felkészülés, a megfelelő infrastruktúra kiépítése és az AI-vezérelt automatizáció bevezetése kritikus fontosságú a jövőbeli versenyképesség szempontjából.

Ne várja meg, amíg a versenytársai lépéselőnybe kerülnek. Kezdje el a felkészülést még ma! Fedezze fel, hogyan alakíthatja át vállalata folyamatait az egyedi automatizálás és a fejlett adatfeldolgozó AI ügynökök segítségével. Lépjen kapcsolatba az AiSolve szakértőivel, és építsük fel együtt a jövőálló, intelligens vállalati architektúráját!

Gyakori Kérdések (FAQ)

Milyen iparágak profitálhatnak leginkább az adatfeldolgozó AI ügynökök kvantum-klasszikus rendszerekben való alkalmazásából?

A leginkább érintett iparágak a logisztika és szállítmányozás (útvonal-optimalizálás), a pénzügyi szektor (kockázatelemzés és portfólió-optimalizálás), a gyógyszeripar (molekuláris szimulációk és gyógyszerkutatás), valamint az anyagtudomány (új, könnyebb és erősebb ötvözetek fejlesztése). Ezek a területek mind olyan extrém komplexitású kombinatorikus problémákkal küzdenek, amelyeket a klasszikus rendszerek már nem tudnak hatékonyan megoldani.

Mennyire biztonságosak az adatfeldolgozó AI ügynökök a kritikus vállalati adatok kezelésében?

Az adatbiztonság elsődleges szempont. A modern AI ügynökök, különösen a vállalati környezetbe integrált megoldások, Zero Trust architektúrára épülnek. A kvantum-hibrid rendszerekben a klasszikus adatok titkosítva maradnak, és csak a szükséges paraméterek kerülnek át a kvantumprocesszorra. Emellett a helyi (on-premise) telepítési lehetőségek és az edge-computing biztosítják, hogy az érzékeny adatok soha ne hagyják el a vállalat belső hálózatát.

Milyen képzettség szükséges egy adatfeldolgozó AI ügynök rendszer implementálásához és kezeléséhez?

A sikeres implementáció interdiszciplináris csapatot igényel. Szükség van adattudósokra (Data Scientists), akik értik a gépi tanulást és az RL modelleket; kvantummérnökökre, akik ismerik a kvantumalgoritmusok alapjait; valamint DevOps és MLOps szakemberekre a skálázható infrastruktúra fenntartásához. Azonban az olyan platformok, mint a CUDA-Q, egyre inkább absztrahálják a komplexitást, lehetővé téve a klasszikus szoftverfejlesztők számára is a belépést.

Hogyan segíti a CUDA-Q platform az NVIDIA Ising modellekkel működő AI ügynökök fejlesztését?

A CUDA-Q egy egységes programozási modellt biztosít, amely zökkenőmentesen köti össze a CPU-kat, GPU-kat és QPU-kat. Lehetővé teszi a fejlesztők számára, hogy standard C++ vagy Python kódot írjanak, amelyet a platform automatikusan optimalizál és oszt el a megfelelő hardverelemek között. Az Ising modellek natívan integrálva vannak ebbe az ökoszisztémába, így az AI ügynökök közvetlenül, minimális késleltetéssel férhetnek hozzá a kvantum-szimulátorokhoz és a fizikai hardverhez.

Melyek a fő kihívások az adatfeldolgozó AI ügynökök nagyléptékű bevezetésében?

A fő kihívások közé tartozik a fizikai kvantumhardverek jelenlegi éretlensége (zajszint és alacsony qubitszám), a klasszikus és kvantum rendszerek közötti adatátviteli késleltetés (latency), valamint a szakemberhiány. Emellett a vállalatoknak meg kell küzdeniük az AI modellek interpretálhatóságának (XAI) problémájával is, hogy a szabályozott iparágakban is bizonyítani tudják a döntéshozatali folyamatok átláthatóságát.

Hogyan viszonyulnak a kvantum AI ügynökök a hagyományos gépi tanulási modellekhez az adatfeldolgozásban?

Míg a hagyományos ML modellek (pl. random forest, mély neurális hálózatok) kiválóak a mintafelismerésben statikus adatokon, a kvantum AI ügynökök autonóm, célorientált entitások. Képesek valós időben interakcióba lépni a kvantumkörnyezettel, megerősítéses tanulást (RL) használni a hibajavításra, és olyan magas dimenziójú optimalizációs problémákat megoldani, amelyek a hagyományos modellek számára számítási szempontból kezelhetetlenek lennének.

Milyen infrastrukturális követelményekkel jár egy kvantum-klasszikus hibrid AI ügynök rendszer?

Egy ilyen rendszer kiépítése magas szintű HPC (High-Performance Computing) infrastruktúrát igényel. Szükség van csúcskategóriás GPU-kra (pl. NVIDIA H100 vagy B200) a klasszikus adatfeldolgozáshoz és az AI ügynökök futtatásához, nagy sávszélességű, alacsony késleltetésű hálózati kapcsolatokra (pl. NVLink, InfiniBand), és hozzáférésre kvantumprocesszorokhoz (akár felhőn keresztül, mint az AWS Braket, akár helyi szimulátorokon, mint a DGX Quantum).

Készen állsz a saját weboldaladra?

Ingyenes konzultáció során átbeszéljük, hogyan segíthetünk vállalkozásodnak növekedni egy modern, gyors és konverzióoptimalizált weboldallal. 14 nap alatt kész, 0 Ft induló költséggel.