Bevezetés: A Mesterséges Intelligencia Következő Generációja az Adatfeldolgozásban

A technológiai világ figyelmét a napokban a Google legújabb bejelentése, az Aletheia projekt és a hozzá kapcsolódó Gemini 3 Deep Think modell kötötte le. A bemutató során a Google egy olyan rendszert demonstrált, amely képes volt önállóan komplex matematikai problémákat megoldani és új tudományos összefüggéseket felfedezni emberi beavatkozás nélkül.

Ez a mérföldkőnek számító esemény egyértelművé tette a vállalati vezetők számára: a passzív, csupán kérdésekre válaszoló nagy nyelvi modellek (LLM-ek) korszaka lezárult. A jövőt az autonóm, célvezérelt rendszerek, azaz az adatfeldolgozó AI ügynökök jelentik, amelyek forradalmasítják az adatokkal való interakciónkat.

A modern vállalatok számára az adatok mennyisége már nem előny, hanem teher, ha nem tudják azokat gyorsan és hatékonyan feldolgozni. A hagyományos adatelemzési módszerek és a statikus dashboardok már nem elegendőek a valós idejű, dinamikus piaci változások lekövetésére. Itt lépnek be a képbe az autonóm ügynökök.

Ezek a fejlett rendszerek nem csupán aggregálják az adatokat, hanem megértik a kontextust, hipotéziseket állítanak fel, és önállóan lefuttatják a szükséges lekérdezéseket. Ez a paradigmaváltás a reaktív IT-működésből a proaktív, AI-vezérelt üzleti intelligencia felé tereli a piacot.

Miért van szükségünk AI ügynökökre az adatokhoz?

A jelenlegi AI paradigmák, mint például a ChatGPT vagy a hagyományos RAG rendszerek, alapvetően chat-interfészekként funkcionálnak. Bár kiválóak szöveggenerálásban és információkeresésben, komoly korlátokba ütköznek, amikor több lépésből álló, komplex adatelemzési feladatokat kell végrehajtaniuk.

Egy hagyományos LLM nem tudja önállóan eldönteni, hogy egy hiányzó adatpont pótlására milyen külső API-t hívjon meg, vagy hogyan tisztítsa meg az inkonzisztens adatbázis-rekordokat. Szükségük van egy emberi operátorra, aki lépésről lépésre vezeti őket a folyamaton, ami lassítja a munkát és növeli a hibalehetőséget.

Ezzel szemben a növekvő üzleti igények olyan rendszereket követelnek, amelyek képesek az önálló érvelésre (reasoning), a tervezésre (planning) és a cselekvésre (acting). Egy igazi AI ügynök képes felismerni egy anomáliát a pénzügyi adatokban, megkeresni annak okát a tranzakciós logokban, és jelentést készíteni a vezetőségnek – mindezt emberi utasítás nélkül.

Ez az autonómia az, ami a puszta automatizációt intelligens munkaerővé emeli. Az adatok exponenciális növekedése miatt az emberi elemzők kapacitása véges, így az AI ügynökök bevezetése nem csupán versenyelőny, hanem a puszta túlélés feltétele a modern adatközpontú gazdaságban.

Mi az Adatfeldolgozó AI Ügynök? Alapfogalmak és Definíciók

Mielőtt mélyebbre ásnánk a technológiai részletekben, fontos tisztázni, mit is értünk pontosan adatfeldolgozó AI ügynök alatt. A piacon uralkodó fogalmi zavar miatt sokan összekeverik a fejlett prompt engineeringet a valódi ügynöki autonómiával.

Egy adatfeldolgozó AI ügynök egy olyan szoftveres entitás, amely egy nagy nyelvi modellt (LLM) használ központi kognitív motorként, de ezt kiegészíti memóriával, tervezési képességekkel és külső eszközök (tool use) használatának lehetőségével. Célja, hogy egy megadott magas szintű célt önállóan elérjen.

Ezek a rendszerek képesek interakcióba lépni a környezetükkel – például SQL adatbázisokkal, REST API-kkal vagy felhőalapú tárolókkal. Nem csak olvassák az adatokat, hanem képesek azokat módosítani, transzformálni és új adatstruktúrákat létrehozni a feladatuk elvégzése érdekében.

Definíció: Adatfeldolgozó AI Ügynök

Olyan autonóm szoftverrendszer, amely mesterséges intelligenciát (jellemzően LLM-et) használ a komplex adatfeldolgozási feladatok megtervezésére, végrehajtására és ellenőrzésére. Képes külső eszközök használatára, hosszú távú memóriával rendelkezik, és emberi beavatkozás nélkül képes alkalmazkodni a változó adatkörnyezethez a kitűzött cél elérése érdekében.

Ügynök vs. LLM: A Különbség Megértése

A legfontosabb különbség a funkcionalitásban és az architektúrában rejlik. Egy LLM önmagában egy statikus függvény: kap egy bemeneti szöveget (prompt), és generál egy kimeneti szöveget. Nincs memóriája a kontextusablakon túl, és nem tud önállóan cselekedni a világban.

Az AI ügynök ezzel szemben egy dinamikus rendszer. Az LLM-et csupán az "agyaként" használja a döntéshozatalhoz. Ha az ügynöknek ki kell számolnia egy bonyolult pénzügyi mutatót, nem az LLM belső (és gyakran pontatlan) matematikai képességeire hagyatkozik, hanem ír egy Python szkriptet, lefuttatja azt, és az eredményt használja fel.

Továbbá, az ügynökök képesek a hibajavításra (self-correction). Ha egy API hívás sikertelen, az ügynök értelmezi a hibaüzenetet, módosítja a paramétereket, és újrapróbálkozik. Ez a visszacsatolási hurok (feedback loop) az, ami igazán robusztussá és megbízhatóvá teszi őket a vállalati környezetben.

Végül, az autonóm AI ágensek képesek a feladatok dekompozíciójára. Egy komplex, több hetes adatintegrációs projektet képesek kisebb, kezelhető részfeladatokra bontani, azokat ütemezni, és az eredményeket szintetizálni.

Az Autonómia Építőkövei: Hogyan Működnek az AI Ügynökök?

Az AI ügynökök működése nem mágia, hanem jól strukturált szoftverarchitekturális minták eredménye. A legelterjedtebb keretrendszerek, mint a LangChain vagy a Microsoft AutoGen, specifikus modulokból építik fel ezeket a rendszereket.

Ezek a rendszerek a ReAct (Reasoning and Acting) paradigmára épülnek, amely folyamatosan váltakozik a logikai érvelés és a fizikai (vagy szoftveres) cselekvés között. Ez biztosítja, hogy az ügynök ne csak vakon hajtson végre parancsokat, hanem értse is azok következményeit.

A működés alapja a folyamatos állapotkezelés (state management). Az ügynöknek tudnia kell, hol tart a feladatban, milyen adatokat gyűjtött eddig össze, és mik a következő lépések. Ezt a memóriamodulok és a kontextusablak intelligens kezelése teszi lehetővé.

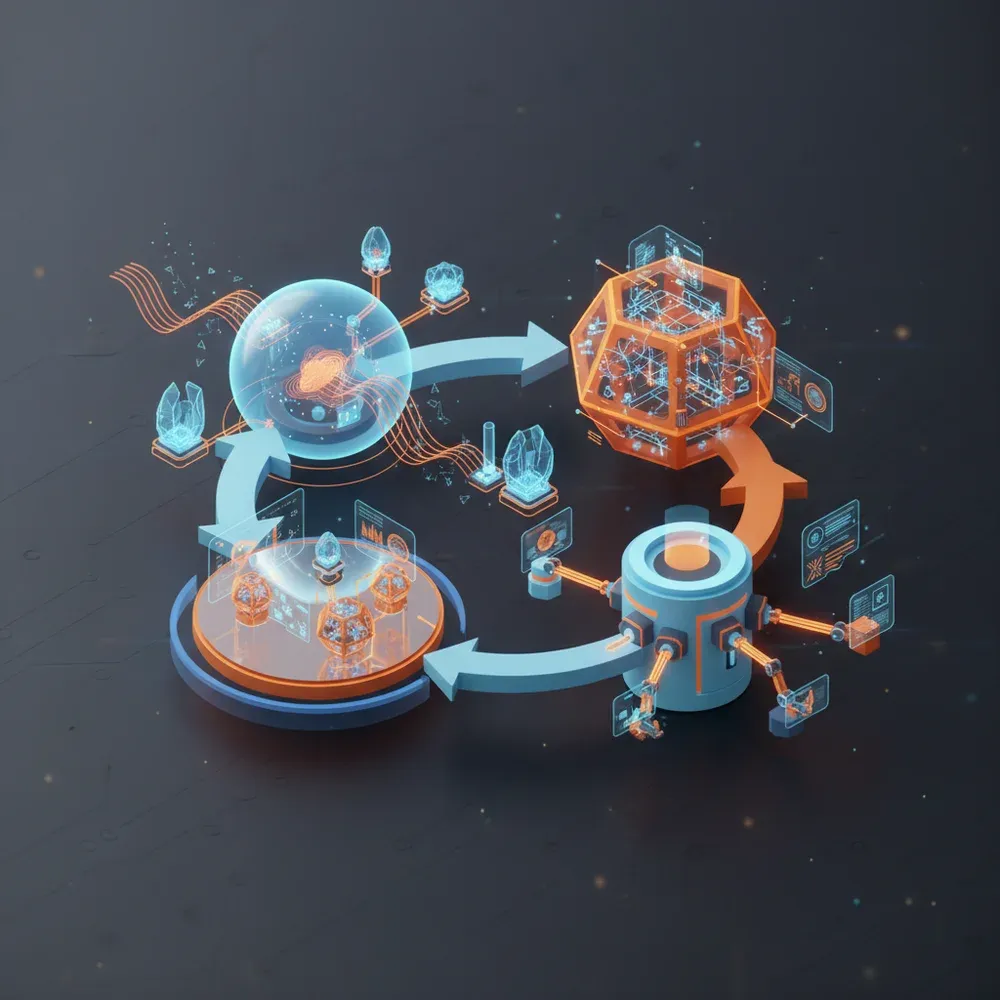

Az Ügynök-Architektúra Kulcselemei: Érzékelés, Tervezés, Cselekvés, Reflexió

Az architektúra első eleme az Érzékelés (Perception). Az ügynök folyamatosan monitorozza a bemeneteket, legyen az egy felhasználói prompt, egy bejövő email, vagy egy adatbázis trigger. Képes strukturálatlan adatokból (pl. PDF dokumentumok) is kinyerni a releváns információkat.

A második fázis a Tervezés (Planning). Itt az ügynök olyan technikákat használ, mint a Chain-of-Thought (CoT) vagy a Tree-of-Thoughts (ToT). Felbontja a fő célt részfeladatokra, és felállít egy végrehajtási gráfot. Képes előre látni a lehetséges buktatókat és alternatív útvonalakat tervezni.

A harmadik lépés a Cselekvés (Action). Az ügynök kiválasztja a megfelelő eszközt a feladathoz. Ha adatot kell keresni, használhat egy AI Chatbot (RAG) rendszert. Ha kódot kell futtatni, elindít egy Docker konténert. A cselekvések mindig a fizikai vagy digitális környezet megváltoztatására irányulnak.

Végül a legfontosabb: a Reflexió (Reflection). A cselekvés után az ügynök megvizsgálja az eredményt. "Sikerült elérnem a részcélt?" Ha nem, elemzi a hibát, frissíti a tervét, és újra próbálkozik. Ez a képesség teszi őket valóban autonómmá.

Az Adatfeldolgozási Munkafolyamat: Lépésről Lépésre

Képzeljünk el egy forgatókönyvet, ahol az ügynök feladata: "Elemezd a Q3-as értékesítési adatokat, és azonosítsd a visszaesés okait a kelet-európai régióban." Az első lépésben az ügynök értelmezi a kérést, és azonosítja a szükséges adatforrásokat (CRM, ERP rendszerek).

A második lépésben SQL lekérdezéseket generál és futtat le az adatbázisokon. Ha az adatok inkonzisztensek (pl. hiányzó dátumok), egy Python Pandas szkripttel megtisztítja azokat. Ezután statisztikai elemzést végez a korrelációk megtalálására.

A harmadik lépésben, ha külső tényezőkre gyanakszik, webes keresést indít a régió makrogazdasági híreivel kapcsolatban. Végül szintetizálja az adatbázisból nyert számokat és a webről gyűjtött kontextust, majd generál egy átfogó, vizualizációkkal ellátott jelentést a vezetőség számára.

Az Aletheia Eset: A Google Úttörő Lépése az Ügynök Alapú Kutatásban

A Google nemrégiben bemutatott Aletheia projektje tökéletes példája annak, hogy hová tart az iparág. Ez a rendszer nem csupán egy újabb chatbot, hanem egy dedikált kutató ügynök, amelyet arra terveztek, hogy a tudományos és adatelemzési határokat feszegesse.

A bejelentés során a Google demonstrálta, hogyan képes az Aletheia önállóan feldolgozni több ezer oldalnyi tudományos publikációt, azonosítani az ellentmondásokat a korábbi kutatásokban, és új, tesztelhető hipotéziseket felállítani a matematika és a fizika területén.

Ami az Aletheiát különlegessé teszi, az a "nyílt végű felfedezés" (open-ended discovery) képessége. Míg a korábbi rendszerek csak arra tudtak válaszolni, amit kérdeztek tőlük, az Aletheia képes saját magának kérdéseket feltenni, és addig kutatni, amíg meg nem találja a választ, akár napokon keresztül futtatva a folyamatokat.

A Gemini 3 Deep Think és az Önálló Tudásfelfedezés

A rendszer lelke a Gemini 3 Deep Think modell, amely szakít a hagyományos, azonnali válaszadásra fókuszáló architektúrával. Ehelyett a modell "gondolkodási időt" (compute-optimal inference time) kap, amely során a háttérben több ezer lehetséges megoldási útvonalat szimulál.

Ez a megközelítés hasonló a Monte Carlo fa kereséshez (MCTS), amelyet az AlphaGo is használt. A modell nem az első eszébe jutó választ adja meg, hanem értékeli a saját gondolatmeneteit, elveti a logikátlanokat, és finomítja a legígéretesebbeket. Ez drasztikusan csökkenti a hallucinációk arányát.

Az önálló tudásfelfedezés révén az Aletheia képes szintetizálni olyan diszciplínákat, amelyeket emberi kutatók ritkán kapcsolnak össze. Például képes a biológiai adatbázisok mintázatait összevetni a kvantumkémiai modellekkel, olyan innovációkat generálva, amelyek felgyorsíthatják a gyógyszerkutatást vagy az anyagtudományt.

Az Adatfeldolgozó AI Ügynökök Alkalmazási Területei és Előnyei

Az autonóm adatfeldolgozó ügynökök nem csupán elméleti koncepciók; már ma is jelentős hatást gyakorolnak a legkülönfélébb iparágakra. A CTO-k és adatközpontú vezetők számára ezek a rendszerek jelentik a kulcsot a skálázhatósági problémák megoldásához.

A legfőbb előnyük, hogy képesek a strukturálatlan adatok (szövegek, képek, hangok) és a strukturált adatok (SQL, NoSQL) közötti szakadék áthidalására. Egyetlen ügynök képes elolvasni egy PDF szerződést, kinyerni belőle a pénzügyi feltételeket, és azokat betáplálni egy ERP rendszerbe.

Az egyedi automatizálás révén ezek az ügynökök pontosan a vállalat specifikus munkafolyamataihoz igazíthatók, megszüntetve a "dobozos" szoftverek merevségét és korlátait.

Tudományos Felfedezés és Kutatás Gyorsítása

A gyógyszeriparban és a biotechnológiában az AI ügynökök hetekről órákra csökkentik a kutatási fázisokat. Képesek hatalmas genomikai adatbázisokat elemezni, azonosítani a betegségekhez kapcsolódó biomarkereket, és javaslatot tenni új molekuláris struktúrákra.

Ezek az ügynökök nemcsak elemzik az adatokat, hanem képesek automatizált laboratóriumi berendezéseket is vezérelni, megtervezve és lefuttatva a szükséges kísérleteket, majd valós időben kiértékelve az eredményeket.

Pénzügyi Elemzés és Kockázatkezelés Automatizálása

A pénzügyi szektorban az ügynökök valós idejű piaci elemzést végeznek, figyelve a globális híreket, a közösségi médiát és a tőzsdei mozgásokat. Képesek másodpercek alatt komplex kockázati modelleket lefuttatni és portfólió-optimalizálási javaslatokat tenni.

A csalásfelderítés (fraud detection) területén az ügynökök folyamatosan monitorozzák a tranzakciós hálózatokat, azonosítva a rejtett mintázatokat és anomáliákat, amelyeket a hagyományos szabályalapú rendszerek gyakran figyelmen kívül hagynak.

Üzleti Intelligencia és Operatív Hatékonyság Növelése

Az ellátási lánc menedzsmentben az ügynökök prediktív analitikát használnak a készlethiányok megelőzésére. Elemzik az időjárási adatokat, a logisztikai útvonalakat és a beszállítói jelentéseket, hogy optimalizálják a szállítási folyamatokat.

Az ügyfélszolgálati adatok elemzése során az AI Telefonos Ügyfélszolgálat rendszerek által generált hang- és szöveges adatokat dolgozzák fel, mélyreható betekintést nyújtva a vásárlói elégedettségbe és a termékfejlesztési irányokba.

Készen áll a vállalati adatok forradalmasítására?

Ne hagyja, hogy adatai kihasználatlanul heverjenek. Implementáljon autonóm AI ügynököket, és növelje cége hatékonyságát.

Kérjen Ingyenes KonzultációtStratégiai Előnyök Vállalatok Számára: Hatékonyság, Pontosság és Innováció

A technológiai innováció önmagában nem elegendő; a C-szintű vezetők számára a megtérülés (ROI) és az üzleti érték a döntő tényező. Az adatfeldolgozó AI ügynökök bevezetése nem csupán egy informatikai projekt, hanem mélyreható üzleti transzformáció.

Ezek a rendszerek drasztikusan csökkentik az operatív költségeket azáltal, hogy automatizálják a munkaigényes, ismétlődő adatelemzési feladatokat. Egy jól konfigurált ügynökhálózat képes egy 10 fős adatelemző csapat manuális munkájának 80%-át elvégezni, töredék idő alatt.

A pontosság növekedése szintén kulcsfontosságú. Az emberi hibák (pl. elgépelések, fáradtság miatti figyelmetlenség) teljesen kiküszöbölhetők. Az ügynökök beépített verifikációs mechanizmusai biztosítják, hogy a generált jelentések és számítások mindig validált adatokon alapuljanak.

Adatvezérelt Döntéshozatal Felgyorsítása

A mai gyorsan változó piacon a késleltetett információ egyenlő a vesztett bevétellel. Az AI ügynökök valós idejű betekintést (real-time insights) biztosítanak a menedzsment számára. Nem kell napokat várni egy havi riportra; az ügynök másodpercek alatt generálja a legfrissebb adatok alapján.

Továbbá, az ügynökök képesek szimulációkat futtatni a "mi lenne, ha" (what-if) forgatókönyvekre. Egy vezető megkérdezheti: "Hogyan hatna a profitunkra, ha a nyersanyagárak 15%-kal emelkednének a következő negyedévben?" Az ügynök azonnal modellezi a hatásokat az egész ellátási láncon keresztül.

Új Üzleti Modellek és Szolgáltatások Lehetőségei

Az Adatfeldolgozó AI-ügynökök nemcsak a meglévő folyamatokat javítják, hanem teljesen új bevételi forrásokat is megnyithatnak. A vállalatok képesek lesznek hiper-személyre szabott szolgáltatásokat nyújtani ügyfeleiknek, valós időben reagálva az egyedi igényekre.

Például egy SaaS cég beépíthet egy saját AI ügynököt a platformjába, amely proaktívan elemzi a felhasználók viselkedését, és automatikusan optimalizálja a beállításaikat a maximális hatékonyság érdekében. Ez jelentősen növeli a felhasználói élményt és csökkenti a lemorzsolódást (churn).

Az AI Ügynökök Bevezetése: Tervezési és Fejlesztési Szempontok

Egy autonóm ügynökhálózat bevezetése komplex mérnöki feladat, amely gondos tervezést igényel. A sikeres implementáció kulcsa a fokozatosság: érdemes egy jól körülhatárolt, magas ROI-val rendelkező pilot projekttel kezdeni, mielőtt a teljes vállalati infrastruktúrát átalakítanánk.

A fejlesztés során a "Human-in-the-loop" (HITL) megközelítés alkalmazása javasolt. Kezdetben az ügynökök csak javaslatokat tesznek, amelyeket egy emberi szakértő hagy jóvá. Ahogy a rendszer bizonyítja megbízhatóságát, az autonómia foka fokozatosan növelhető.

A felhasználói felületek kialakítása is kritikus. A belső csapatok számára egy intuitív dashboard szükséges, ahol nyomon követhetik az ügynökök tevékenységét. Ebben a professzionális weboldal készítés és frontend fejlesztés elengedhetetlen szerepet játszik.

A Megfelelő Technológiai Stack Kiválasztása és Integráció

A technológiai alapok kiválasztása meghatározza a rendszer skálázhatóságát. A fejlesztőknek dönteniük kell a nyílt forráskódú keretrendszerek (pl. LangChain, LlamaIndex, CrewAI) és a menedzselt felhőszolgáltatások között. A nyelvi modellek terén a GPT-4o, a Claude 3.5 Sonnet vagy a Gemini 3 Pro a leggyakoribb választások.

A memóriakezeléshez elengedhetetlen egy robusztus vektoradatbázis (pl. Pinecone, Qdrant, Weaviate) integrálása. Ez teszi lehetővé a szemantikus keresést és a hosszú távú kontextus megőrzését. A rendszer orkesztrációját gyakran Kubernetes alapokon valósítják meg a magas rendelkezésre állás érdekében.

Adatintegráció, Adatminőség és Adatirányítás

Az AI ügynökök csak annyira jók, mint az adatok, amelyekkel dolgoznak ("Garbage in, garbage out"). A bevezetés előtt elengedhetetlen a vállalati adattavak (data lakes) és adattárházak (data warehouses) megtisztítása és strukturálása.

Az adatminőség biztosítása mellett az adatirányítás (Data Governance) is kulcsfontosságú. Pontosan meg kell határozni, hogy melyik ügynök milyen adatokhoz férhet hozzá, és milyen műveleteket hajthat végre azokon, megelőzve a jogosulatlan adatmódosításokat.

Kihívások és Megfontolások: Biztonság, Etika és Skálázhatóság

Bármilyen ígéretesek is az autonóm rendszerek, bevezetésük komoly kockázatokkal jár. Egy olyan szoftver, amely önállóan képes API-kat hívni és adatbázisokat módosítani, potenciális biztonsági rést jelenthet, ha nincs megfelelően izolálva.

A "Prompt Injection" támadások különösen veszélyesek az ügynökökre nézve. Ha egy rosszindulatú felhasználó olyan adatot táplál a rendszerbe, amely rejtett utasításokat tartalmaz, az ügynök akaratlanul is végrehajthatja a támadó parancsait (pl. adatszivárogtatás).

Ennek elkerülése érdekében a vállalatoknak Zero Trust architektúrát kell alkalmazniuk. Az ügynököknek csak a legszükségesebb jogosultságokkal (Principle of Least Privilege) szabad rendelkezniük, és minden kritikus műveletet (pl. pénzügyi tranzakció, adatbázis törlés) emberi jóváhagyáshoz kell kötni.

Adatbiztonság, Adatvédelem és Compliance

A GDPR és más adatvédelmi szabályozások szigorú követelményeket támasztanak a személyes adatok kezelésével kapcsolatban. Ha egy AI ügynök ügyféladatokat dolgoz fel, biztosítani kell, hogy a modell ne tanulja meg és ne szivárogtassa ki ezeket az információkat.

A megoldás gyakran a helyi, on-premise modellek futtatása, vagy az adatok szigorú anonimizálása, mielőtt azok a felhőalapú LLM-ekhez kerülnének. Az auditálhatóság szintén kritikus: a rendszernek minden ügynöki döntésről részletes, visszakövethető naplót (log) kell vezetnie.

Etikai Dilemmák, Elfogultság és Az Ügynökök Felügyelete

Az AI modellek gyakran öröklik a betanítási adataikban lévő emberi elfogultságokat (bias). Ha egy HR adatokkal dolgozó ügynök autonóm módon szűri a jelentkezőket, fennáll a diszkrimináció veszélye. A vállalatoknak folyamatosan tesztelniük kell az ügynökök döntéseit a fairness és az etikai normák szempontjából.

A felelősség kérdése is tisztázandó: ha egy autonóm ügynök hibás pénzügyi döntést hoz, ki a felelős? A fejlesztő, a felhasználó, vagy az AI szolgáltató? A robusztus felügyeleti keretrendszerek kialakítása elengedhetetlen a bizalom kiépítéséhez.

Skálázhatóság és Erőforrás-Igény Kezelése

Az ügynöki munkafolyamatok rendkívül számításigényesek. Míg egy egyszerű chat válasz egyetlen API hívást jelent, egy komplex kutatási feladat több száz iterációt és LLM hívást igényelhet, ami drasztikusan megnöveli a felhő-költségeket (GPU idő).

A vállalatoknak optimalizálniuk kell az erőforrás-felhasználást. Ezt megtehetik kisebb, specializált modellek (SLM - Small Language Models) használatával a rutinfeladatokra, és csak a legbonyolultabb érvelési fázisokban hívják segítségül a drága, csúcskategóriás modelleket.

A Jövő Adatfeldolgozása: Autonóm Rendszerek és Emberi Szinergia

Ahogy az AI ügynökök egyre kifinomultabbá válnak, felmerül a kérdés: mi lesz az emberi munkaerő sorsa? A félelmekkel ellentétben a jövő nem a teljes emberi helyettesítésről, hanem a szinergiáról szól. Az ügynökök elveszik a monoton, adat-intenzív feladatokat, felszabadítva az embereket a kreatív és stratégiai munkára.

A jövő vállalataiban a munkavállalók nem adatokat fognak tisztítani, hanem "ügynök-menedzserekként" fognak dolgozni. Ők határozzák meg a magas szintű üzleti célokat, felügyelik az ügynökrajok (agent swarms) munkáját, és értelmezik a komplex, szintetizált eredményeket.

Az Adattudós Szerepének Átalakulása

A data scientist szerepkör jelentős átalakuláson megy keresztül. Ahelyett, hogy heteket töltenének adat-előkészítéssel (data wrangling) és alapvető modellek betanításával, az adattudósok egyre inkább az AI rendszerek architektúrájának tervezésére és az üzleti logika integrálására fókuszálnak.

A jövő adattudósa egy orkesztrátor lesz, aki kiválasztja a megfelelő ügynöki keretrendszereket, optimalizálja a promptokat és a kontextus-ablakokat, valamint biztosítja, hogy a gépi intelligencia összhangban legyen a vállalat stratégiai céljaival.

A Hibrid Intelligencia Korszaka

A végső cél a hibrid intelligencia elérése, ahol az emberi intuíció, empátia és kreativitás zökkenőmentesen ötvöződik az AI ügynökök számítási kapacitásával, sebességével és fáradhatatlanságával.

Ebben a korszakban a legversenyképesebb vállalatok azok lesznek, amelyek a leggyorsabban képesek integrálni ezeket az autonóm rendszereket a mindennapi működésükbe, létrehozva egy olyan agilis szervezetet, amely azonnal reagál a világ változásaira.

Következtetés: Készüljön Fel az Adatfeldolgozás Forradalmára

A Google Aletheia és a hasonló fejlett rendszerek megjelenése bizonyítja, hogy az adatfeldolgozó AI ügynökök már nem a távoli jövő sci-fi ígéretei, hanem a jelen valósága. A passzív adatbázisoktól az aktív, gondolkodó rendszerek felé történő elmozdulás az évtized legfontosabb technológiai paradigmaváltása.

Azok a vállalatok, amelyek felismerik és alkalmazzák ezt a technológiát, exponenciális növekedést, drasztikus költségcsökkentést és behozhatatlan versenyelőnyt érhetnek el. Azok viszont, akik ragaszkodnak a hagyományos, manuális adatfeldolgozási módszerekhez, hamarosan lemaradnak a piacon.

Az AiSolve szakértő csapata készen áll arra, hogy végigvezesse vállalatát ezen a transzformációs úton, a stratégiai tervezéstől a biztonságos, skálázható implementációig.

Lépjen a Jövőbe az AiSolve Segítségével

Automatizálja adatfeldolgozását, csökkentse költségeit és növelje hatékonyságát egyedi AI ügynök megoldásainkkal.

Kezdjük el a közös munkátMi a fő különbség egy hagyományos LLM és egy adatfeldolgozó AI ügynök között?

Míg egy hagyományos LLM (mint a ChatGPT) egy passzív rendszer, amely csupán a betanított adatai alapján generál szöveges válaszokat egy promptra, addig az AI ügynök egy aktív, autonóm szoftver. Az ügynök képes memóriát használni, komplex feladatokat lépésekre bontani (tervezés), külső eszközöket (API-k, adatbázisok) használni, és a kapott eredmények alapján korrigálni a saját hibáit a cél elérése érdekében.

Hogyan biztosítják az adatfeldolgozó AI ügynökök az adatbiztonságot és a magánélet védelmét?

A biztonságot többrétegű védelemmel biztosítják. Ide tartozik a Zero Trust architektúra alkalmazása, ahol az ügynökök csak a legszükségesebb adatokhoz férnek hozzá (Role-Based Access Control). Érzékeny adatok esetén gyakran alkalmaznak adat-anonimizálást az LLM hívások előtt, vagy on-premise (helyben futó) nyílt forráskódú modelleket használnak, így az adatok soha nem hagyják el a vállalat belső hálózatát.

Milyen tipikus kihívások merülnek fel az AI ügynökök meglévő vállalati rendszerekbe való integrálásakor?

A leggyakoribb kihívások közé tartozik a rossz adatminőség (strukturálatlan, inkonzisztens adatok), a legacy (elavult) IT rendszerek API végpontjainak hiánya, valamint a "hallucinációk" kezelése. Emellett komoly kihívás a skálázhatóság biztosítása és a felhő-költségek (API hívások díjai) kordában tartása a komplex, soklépéses ügynöki munkafolyamatok során.

Képesek-e az AI ügynökök valóban új tudást felfedezni, vagy csak meglévő adatokat dolgoznak fel?

A legújabb rendszerek, mint a Google Aletheia vagy a Gemini 3 Deep Think, már képesek az úgynevezett "nyílt végű felfedezésre". Bár az alapvető tudásuk a betanítási adatokból származik, képesek meglévő információk szintetizálásával, logikai dedukcióval és szimulációk futtatásával olyan új összefüggéseket, hipotéziseket és matematikai bizonyításokat létrehozni, amelyeket korábban emberi kutatók nem dokumentáltak.

Milyen készségek elengedhetetlenek egy adattudományi csapat számára, amely AI ügynököket szeretne bevezetni?

A hagyományos gépi tanulási és statisztikai ismeretek mellett a csapatnak jártasnak kell lennie az LLM orkesztrációs keretrendszerekben (pl. LangChain, AutoGen), a vektoradatbázisok kezelésében, a prompt engineering haladó technikáiban (pl. Chain-of-Thought), valamint a felhőalapú infrastruktúra és a konténerizáció (Docker, Kubernetes) területén a skálázható telepítéshez.

Milyen megtérülést (ROI) várhatunk az adatfeldolgozó AI ügynökökbe való befektetéstől egy nagyvállalatnál?

A ROI jellemzően rendkívül magas, gyakran már az első 6-12 hónapban jelentkezik. A megtérülés a manuális adatfeldolgozásra fordított munkaórák drasztikus (akár 70-80%-os) csökkenéséből, a hibák minimalizálásából adódó költségmegtakarításból, valamint a valós idejű, adatalapú döntéshozatal révén elért bevételnövekedésből és optimalizált folyamatokból (pl. hatékonyabb ellátási lánc) tevődik össze.

Készen állsz a saját weboldaladra?

Ingyenes konzultáció során átbeszéljük, hogyan segíthetünk vállalkozásodnak növekedni egy modern, gyors és konverzióoptimalizált weboldallal. 14 nap alatt kész, 0 Ft induló költséggel.