A legújabb Teleport kiberbiztonsági jelentés rávilágított: azok a vállalatok, amelyek túlzott hozzáférési jogosultságokat adnak az AI rendszereiknek, 4,5-szer több biztonsági incidenst szenvednek el. Bár az adatfeldolgozó AI-ügynökök forradalmasítják a hatékonyságot, a hagyományos IAM (Identity and Access Management) rendszerek elégtelenek a gép-gép közötti, autonóm interakciók védelmére. A CTO-k és CISO-k számára a Zero Trust architektúra, a legkevesebb privilégium elve és a folyamatos auditálás bevezetése nem csupán ajánlott, hanem kritikus üzleti prioritás az "agentikus adósság" elkerülése érdekében.

Bevezetés: Az AI kettős éle – Innováció és bizonytalanság

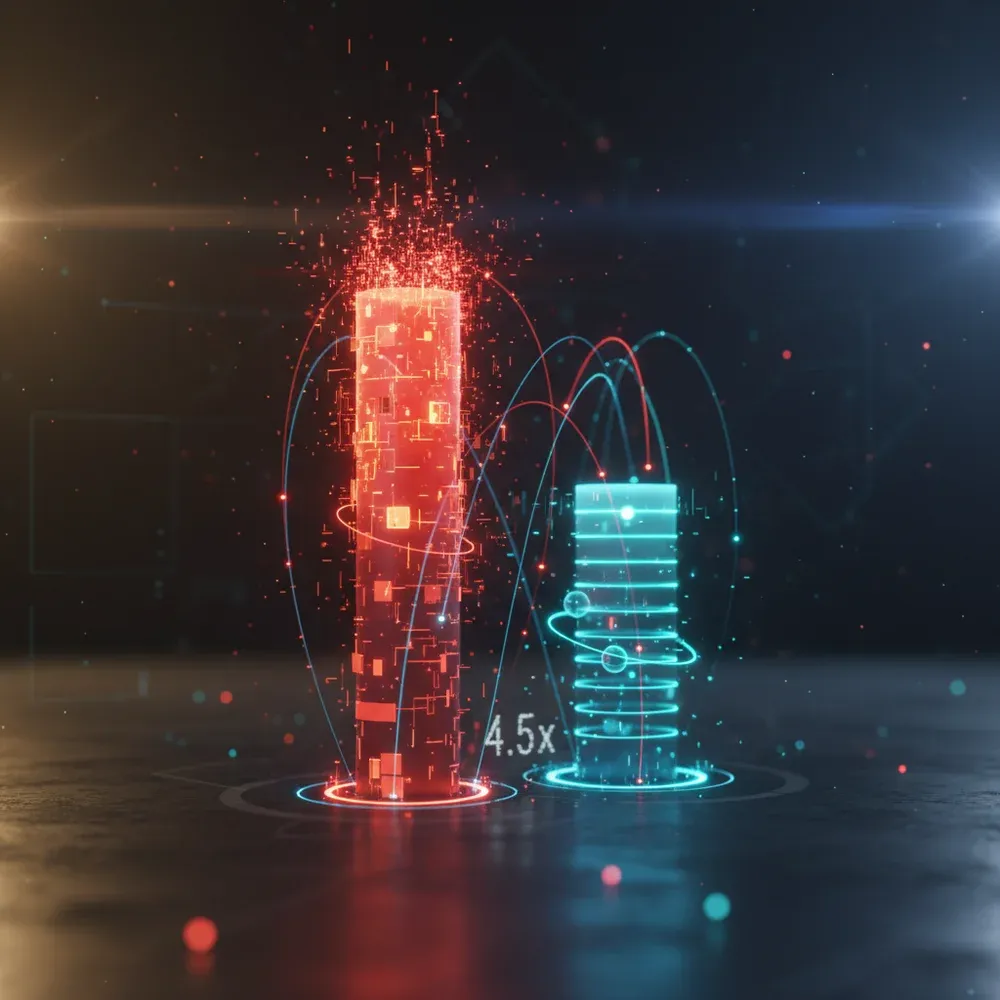

A modern technológiai térkép legfrissebb és leginkább kijózanító adata a Teleport kiberbiztonsági jelentéséből származik: a túlzottan privilegizált AI rendszerekkel rendelkező vállalatok 4,5-szer nagyobb valószínűséggel válnak adatvédelmi incidensek áldozatává. Ez a statisztika azonnal újraírja azt, ahogyan a vállalati automatizálásról gondolkodunk. Nem elég csupán integrálni a legújabb nyelvi modelleket; a fókusz a biztonságos implementációra helyeződött át.

Az AI kettős éle sosem volt még ennyire nyilvánvaló. Egyrészt az autonóm rendszerek képesek hetek munkáját másodpercek alatt elvégezni, másrészt egyetlen rosszul konfigurált API kulcs vagy kontextusablak teljes adatbázisok kompromittálódásához vezethet. A biztonságos AI automatizálás ma már nem csupán IT feladat, hanem alapvető vállalatirányítási kérdés.

Ebben a mélyreható technikai útmutatóban feltárjuk, miért omlanak össze a hagyományos biztonsági paradigmák az autonóm ügynökök súlya alatt. Részletesen megvizsgáljuk a 4,5-szeres kockázati szorzó anatómiáját, és konkrét, mérnöki szintű stratégiákat adunk a Zero Trust architektúra bevezetéséhez a gép-gép (M2M) kommunikációban.

Adatfeldolgozó AI ügynökök megértése: A modern vállalat motorja

Mielőtt megértenénk a kockázatokat, tisztáznunk kell, mik is pontosan ezek a rendszerek. Az adatfeldolgozó AI ügynökök nem egyszerű chatbotok, amelyek passzívan várják a felhasználói promptokat. Ezek autonóm szoftveres entitások, amelyek képesek önállóan navigálni a vállalati hálózatokban, adatokat kinyerni, transzformálni és betölteni (ETL folyamatok).

Ezek az ügynökök nagy nyelvi modelleket (LLM) használnak "kognitív motorként", hogy megértsék a strukturálatlan adatokat, majd API-hívásokon és adatbázis-lekérdezéseken keresztül strukturált, végrehajtható műveletekké alakítsák azokat. Képesek önállóan SQL kódokat írni, futtatni, és az eredmények alapján további döntéseket hozni.

Definíció: Adatfeldolgozó AI Ügynök

Olyan autonóm szoftverrendszer, amely mesterséges intelligenciát (jellemzően LLM-eket) használ a vállalati adatok önálló azonosítására, kinyerésére, elemzésére és módosítására. Rendelkezik saját végrehajtási környezettel, memóriával (vektoradatbázisok) és hozzáférési jogosultságokkal a belső rendszerekhez.

Az AI ügynökök típusai és alkalmazásai

A vállalati ökoszisztémában többféle ügynöktípus létezik, mindegyik eltérő hozzáférési profillal. A RPA (Robotic Process Automation) ügynökök a repetitív, szabályalapú adatmozgatásért felelnek, gyakran örökölt (legacy) rendszerek között, ahol az API-k nem elérhetők.

Az intelligens elemző ügynökök (Analytical Agents) közvetlen olvasási hozzáféréssel rendelkeznek az adattárházakhoz (pl. Snowflake, BigQuery). Ezek az ügynökök képesek terabájtnyi adatot átvizsgálni anomáliák vagy trendek után kutatva, amihez hatalmas sávszélességre és széleskörű adathozzáférésre van szükségük.

A legmagasabb kockázatot a döntéshozó ügynökök (Decision Agents) jelentik. Ezek írási jogosultsággal is rendelkeznek, képesek módosítani a CRM rekordokat, jóváhagyni pénzügyi tranzakciókat, vagy akár infrastruktúrát skálázni a felhőben. Az egyedi automatizálás során ezek az ügynökök jelentik a legnagyobb értéket, de egyben a legnagyobb sebezhetőséget is.

Hogyan alakítják át az AI ügynökök az adatmunkafolyamatokat?

A hagyományos adatfeldolgozási csővezetékek (pipelines) merevek. Ha a bemeneti adat struktúrája megváltozik, a pipeline eltörik, és emberi beavatkozást igényel. Az AI ügynökök bevezetésével a munkafolyamatok dinamikussá és öngyógyítóvá válnak.

Például, ha egy beszállító megváltoztatja a számlaformátumát, egy adatfeldolgozó AI ügynök képes vizuálisan és szemantikailag értelmezni az új dokumentumot, módosítani a saját extrakciós logikáját, és megszakítás nélkül folytatni a munkát. Ez a rugalmasság drasztikusan csökkenti az IT karbantartási költségeit és növeli az adatok feldolgozásának sebességét.

A '4.5-szeres kockázati szorzó': Az AI rejtett biztonsági sebezhetősége

A Teleport jelentése rávilágított a kényelem és a biztonság közötti klasszikus kompromisszum modern inkarnációjára. Amikor a fejlesztők AI ügynököket integrálnak, gyakran szembesülnek azzal, hogy az ügynöknek tucatnyi különböző rendszerhez kell hozzáférnie a feladata elvégzéséhez.

A gyors prototipizálás (és a piacra jutás kényszere) miatt a mérnökök hajlamosak "széles körű" (wildcard) hozzáférést, vagy akár adminisztrátori szintű tokeneket adni ezeknek az ügynököknek. Ez a gyakorlat hozza létre a 4,5-szeres kockázati szorzót. Az AI ügynök lényegében egy "szuperfelhasználóvá" válik, amely soha nem alszik, és másodpercenként ezer műveletet képes végrehajtani.

A túlzottan privilégiumos AI fiókok veszélye

Egy túlzottan privilegizált AI fiók hatalmas támadási felületet jelent. A hagyományos szoftverekkel ellentétben az LLM-alapú ügynökök fogékonyak a prompt injection (prompt injektálás) támadásokra. Ha egy támadó képes manipulálni az ügynök bemeneti adatait, ráveheti az ügynököt, hogy a saját (magas szintű) jogosultságaival hajtson végre rosszindulatú kódokat.

Képzeljünk el egy ügyfélszolgálati AI Chatbotot, amelynek olvasási és írási joga van a teljes ügyféladatbázishoz. Egy megfelelően megfogalmazott, rejtett utasításokat tartalmazó e-mail vagy chat üzenet arra utasíthatja az ügynököt, hogy exportálja a teljes adatbázist egy külső szerverre. Mivel az ügynök rendelkezik a szükséges jogosultságokkal, a hagyományos tűzfalak nem fogják blokkolni a belső lekérdezést.

Az AI hozzáférési jogsértések valós következményei

A következmények messze túlmutatnak az egyszerű adatszivárgáson. Egy kompromittált AI ügynök képes "laterális mozgásra" (lateral movement) a hálózaton belül. Mivel az ügynökök gyakran kommunikálnak más ügynökökkel (Multi-Agent Systems), a fertőzés futótűzként terjedhet a belső infrastruktúrában.

Egy valós forgatókönyv szerint egy pénzügyi elemző ügynök, amelyet manipuláltak, mikroszkopikus, emberi szemmel észrevehetetlen módosításokat hajthat végre a tranzakciós adatokban. Ez nemcsak azonnali pénzügyi veszteséget okoz, hanem hetekre megbéníthatja az audit folyamatokat, és helyrehozhatatlan károkat okozhat a vállalat hírnevében és a szabályozói (pl. GDPR) megfelelésben.

Túl a hagyományos IAM-en: AI ügynökök biztonsága Zero Trust környezetben

A probléma gyökere az, hogy a jelenlegi Identity and Access Management (IAM) rendszereket emberi felhasználókra tervezték. Az emberi viselkedés viszonylag kiszámítható: munkaidőben jelentkezünk be, meghatározott IP-címekről, és limitált számú fájlt nyitunk meg. Az AI ügynökök viselkedése ezzel szemben aszinkron, folyamatos és hatalmas volumenű.

A statikus szerepkör-alapú hozzáférés-vezérlés (RBAC) megbukik az AI környezetben. Ha egy ügynöknek csak napi 5 percre van szüksége hozzáférésre egy specifikus S3 vödörhöz, a 24/7-es hozzáférés biztosítása indokolatlan kockázat. Ezért van szükség a paradigmaváltásra a Zero Trust (Zéró Bizalom) architektúra felé.

Miért elégtelen a hagyományos IAM az AI számára?

A hagyományos IAM jelszavakra, MFA-ra (többtényezős hitelesítés) és hosszú élettartamú API kulcsokra támaszkodik. Az AI ügynökök nem tudnak SMS-kódot beírni. Ha egy hosszú élettartamú API kulcsot beégetnek az ügynök kódjába vagy környezeti változóiba, az egy esetleges kódszivárgás esetén azonnal a támadók kezébe kerül.

Továbbá, az IAM rendszerek nehezen kezelik a "kontextust" gép-gép kommunikáció esetén. Egy hagyományos rendszer csak azt látja, hogy az érvényes token megérkezett, de azt nem tudja kiértékelni, hogy az adott lekérdezés logikailag illeszkedik-e az ügynök jelenlegi feladatához. Ez a vakfolt teszi lehetővé a prompt injektáláson alapuló adatszivárgást.

A Zero Trust alapelvei AI környezetekhez

A Zero Trust alapelve – "sose bízz, mindig ellenőrizz" – tökéletesen alkalmazható az AI ügynökökre. Az első lépés a mikroszegmentáció: az ügynököket izolált hálózati szegmensekben kell futtatni, szigorú kimenő és bejövő forgalomszabályozással. Egy belső adatfeldolgozó ügynöknek semmi keresnivalója a publikus interneten.

A második pillér a gép-identitás (Machine Identity) kezelése. A statikus API kulcsok helyett dinamikus, rövid élettartamú (ephemeral) tokeneket kell használni. Olyan protokollok, mint a SPIFFE (Secure Production Identity Framework for Everyone) lehetővé teszik, hogy az ügynökök kriptográfiailag bizonyítsák identitásukat, és csak a feladat elvégzésének idejére kapjanak hozzáférést (Just-In-Time access).

Biztonságos hozzáférési szabályzatok tervezése adatfeldolgozó AI ügynökök számára

Az elmélet gyakorlatba ültetése precíz mérnöki munkát igényel. A biztonságos hozzáférési szabályzatok tervezésekor a cél a "robbanási sugár" (blast radius) minimalizálása. Ha egy ügynök kompromittálódik, a kárnak szigorúan arra a specifikus adatkészletre kell korlátozódnia, amellyel éppen dolgozott.

Ennek eléréséhez át kell térnünk az attribútum-alapú hozzáférés-vezérlésre (ABAC), ahol a jogosultságokat nem csak az ügynök "szerepköre", hanem a lekérdezés időpontja, a hálózati lokáció és az adatok érzékenységi szintje is meghatározza.

A legkevesebb privilégium elvének alkalmazása AI munkafolyamatokhoz

A legkevesebb privilégium (Least Privilege) elve azt diktálja, hogy az AI ügynök csak a feladatához elengedhetetlenül szükséges minimális jogokat kapja meg. Ha egy ügynök feladata a napi eladási jelentések aggregálása, akkor kizárólag olvasási jogot (READ) kaphat az eladási táblákra, és semmilyen hozzáférést (DENY) a felhasználói jelszó-hash táblákhoz.

A felhőkörnyezetekben (AWS, GCP, Azure) ezt rendkívül granuláris IAM policy-k írásával lehet elérni. Például egy AWS IAM policy korlátozhatja az ügynököt, hogy csak azokat az S3 objektumokat olvassa, amelyek rendelkeznek egy specifikus `project=ai-analytics` címkével. Ez a szintű izoláció az alapja a vállalati szintű autonóm AI stratégiának.

Környezetfüggő hozzáférés-vezérlés dinamikus AI műveletekhez

A környezetfüggő (Context-Aware) hozzáférés egy lépéssel tovább megy. A rendszer folyamatosan értékeli a lekérdezés kontextusát. Ha egy magyarországi szerveren futó ügynök hirtelen egy kínai IP-címről próbál adatokat továbbítani, a rendszer azonnal blokkolja a tranzakciót, még akkor is, ha az API kulcs érvényes.

Ugyanez igaz a lekérdezések volumenére is. Ha egy ügynök, amely történelmileg másodpercenként 5 lekérdezést futtat, hirtelen 5000 lekérdezést indít (ami adatkiszivattyúzásra utalhat), a dinamikus szabályzatok azonnal visszavonják a hozzáférést (rate limiting és circuit breaking mechanizmusok).

Szabályzatenforcement és orvoslás automatizálása

Mivel az AI ügynökök gépi sebességgel működnek, a biztonsági válaszlépéseknek is automatizáltnak kell lenniük. Az emberi beavatkozásra várni egy incidens során végzetes lehet. Olyan eszközöket kell integrálni, mint az OPA (Open Policy Agent), amely valós időben, milliszekundumok alatt értékeli ki a hozzáférési kéréseket.

Ha egy szabálysértés történik, az automatizált orvoslás (remediation) azonnal életbe lép. Ez jelentheti az ügynök hálózati izolálását, a tokenek azonnali visszavonását, vagy az ügynök konténerének teljes leállítását (kill switch). Az eseményről részletes riasztás megy a biztonsági csapatnak (SOC) a későbbi elemzéshez.

Folyamatos felügyelet és auditálás: Az AI ügynök tevékenységének őrtornya

A megelőzés (Zero Trust, IAM) csak az egyenlet egyik fele. A másik a folyamatos láthatóság. A feketedobozként működő AI ügynökök elfogadhatatlanok egy nagyvállalati környezetben. A CTO-knak pontosan tudniuk kell, hogy az ügynök milyen adatokat olvasott, milyen döntéseket hozott, és miért.

A megfigyelhetőség (Observability) az AI rendszerek esetében jóval komplexebb, mint a hagyományos szoftvereknél. Nemcsak a CPU használatot és a hálózati forgalmat kell mérni, hanem az LLM promptokat, a generált válaszokat, a token-felhasználást és a szemantikai hasonlóságokat is a vektoradatbázisokban.

Valós idejű fenyegetésészlelés és anomáliaelemzés

A valós idejű fenyegetésészleléshez fejlett SIEM (Security Information and Event Management) rendszerekre van szükség, amelyeket kifejezetten AI munkaterhelésekre optimalizáltak. Ezek a rendszerek gépi tanulást használnak az ügynökök "normális" viselkedési profiljának (baseline) felépítéséhez.

Ha egy ügynök hirtelen olyan adatbázis-táblákat kezd el olvasni, amelyeket korábban soha, vagy a generált SQL lekérdezések struktúrája gyanúsan megváltozik (pl. `DROP TABLE` parancsok jelennek meg), az anomáliaelemző motor azonnal riasztást küld. A prompt-injektálási kísérletek detektálására speciális LLM-tűzfalakat (LLM Firewalls) alkalmaznak, amelyek szemantikailag szűrik a bejövő és kimenő szövegeket.

Átfogó naplózás és audit nyomvonalak a megfelelőséghez

A megfelelőség (Compliance) szempontjából a megváltoztathatatlan (immutable) audit naplók kritikusak. Minden egyes API hívást, adatbázis lekérdezést és LLM interakciót kriptográfiailag aláírva kell tárolni. Ez biztosítja, hogy egy esetleges incidens során a forenzikus elemzők pontosan rekonstruálni tudják az eseményeket.

Ezek az audit nyomvonalak elengedhetetlenek a szabályozó hatóságok (pl. NAIH, GDPR ellenőrök) felé történő bizonyításhoz is. Meg kell tudni mutatni, hogy az AI ügynök milyen adatok alapján hozott meg egy adott döntést, és hogy a hozzáférések szigorúan szabályozottak voltak.

Az emberi tényező: Irányítás, etika és felelős AI telepítés

A technológiai megoldások önmagukban nem elegendők. A 4,5-szeres kockázati szorzó gyakran nem a technológia hibája, hanem a hiányos vállalati folyamatok és az emberi mulasztások eredménye. Az AI irányítás (AI Governance) az a keretrendszer, amely összeköti a technológiát az üzleti és etikai célokkal.

Egy jól működő AI biztonsági stratégia megköveteli a "Human-in-the-Loop" (HITL) vagy "Human-on-the-Loop" (HOTL) megközelítést. A kritikus döntéseket (pl. nagy összegű utalások, érzékeny adatok tömeges törlése) soha nem szabad teljesen autonóm ügynökökre bízni; mindig szükség van egy emberi jóváhagyási lépésre.

AI irányítási keretrendszerek létrehozása

Minden vállalatnak létre kell hoznia egy dedikált AI Biztonsági Bizottságot, amely felügyeli az ügynökök fejlesztését és telepítését. Ez a keretrendszer határozza meg, hogy milyen típusú adatokhoz férhetnek hozzá az ügynökök, milyen LLM modelleket lehet használni (pl. nyílt forráskódú vs. zárt, on-premise vs. felhő), és mik a kötelező biztonsági tesztelési lépések a kód élesítése előtt.

A keretrendszernek tartalmaznia kell egy "AI Bill of Materials" (AI-BOM) koncepciót is, amely pontosan dokumentálja, hogy egy adott ügynök milyen modellekből, könyvtárakból és adatkészletekből épül fel, megkönnyítve a sebezhetőségek (pl. CVE-k) gyors azonosítását.

Etikai megfontolások az AI ügynökök telepítésében

Az etika és a biztonság kéz a kézben járnak. Ha egy adatfeldolgozó ügynök torzított (biased) adatokon lett betanítva, vagy a promptjai nem tartalmaznak megfelelő etikai korlátokat, diszkriminatív döntéseket hozhat (pl. hitelbírálat vagy HR szűrés során). Ez nemcsak etikai probléma, hanem komoly jogi és reputációs kockázat is.

A fejlesztőknek proaktívan tesztelniük kell az ügynököket a "hallucinációk" és a káros kimenetek ellen. A RAG (Retrieval-Augmented Generation) technológia alkalmazása segít abban, hogy az ügynökök szigorúan a vállalat saját, ellenőrzött tudásbázisára támaszkodjanak, minimalizálva a téves információk generálásának esélyét.

Navigálás a szabályozási megfelelőségben (GDPR, HIPAA stb.)

Az autonóm adatfeldolgozás komoly kihívásokat támaszt a GDPR (Általános Adatvédelmi Rendelet) és más iparági szabványok (pl. HIPAA az egészségügyben) tekintetében. A GDPR megköveteli az adatminimalizálást és a célhoz kötöttséget. Egy AI ügynök nem gyűjthet és elemezhet személyes adatokat "csak úgy", anélkül, hogy annak világos, dokumentált üzleti célja lenne.

Továbbá, a felhasználóknak joguk van a "felejtéshez" és az automatizált döntéshozatal elleni tiltakozáshoz. A vállalatoknak olyan mechanizmusokat kell kiépíteniük, amelyekkel képesek azonosítani és törölni egy adott személyhez tartozó adatokat az AI ügynökök memóriájából (vektoradatbázisokból) és naplóiból is.

AI biztonsági stratégiájának jövőbiztosítása: Felmerülő fenyegetések és megoldások

A kiberbiztonság egy folyamatos macska-egér játék. Ahogy az AI ügynökök egyre kifinomultabbá válnak, úgy fejlődnek a támadási vektorok is. A jövőbiztos stratégia nem csupán a mai fenyegetésekre reagál, hanem felkészül a holnap kihívásaira, beleértve a kvantumszámítástechnikát és a mesterséges intelligencia által vezérelt kibertámadásokat.

A támadók is használnak AI-t. Az "Adversarial AI" (ellenséges AI) képes automatikusan felfedezni az ügynökök sebezhetőségeit, másodpercenként több ezer mutálódó prompt-injektálási kísérletet generálva. Ezt a tempót emberi elemzőkkel lehetetlen felvenni.

Felkészülés a fejlett tartós fenyegetésekre

Az APT-k (Advanced Persistent Threats) célja, hogy észrevétlenül, hosszú ideig megbújjanak a hálózatban. Egy kompromittált AI ügynök tökéletes trójai faló. A védekezéshez a vállalatoknak "Deception Technology"-t (megtévesztési technológiát) kell alkalmazniuk: hamis adatbázisokat (honeypots) és API végpontokat kell létrehozni, amelyek csapdaként szolgálnak az oldalirányban mozgó, kompromittált ügynökök számára.

A fenyegetés-modellezést (Threat Modeling) folyamatosan frissíteni kell. A fejlesztési ciklus (DevSecOps) részévé kell tenni a "Red Teaming" gyakorlatokat, ahol etikus hackerek (vagy erre specializált AI modellek) próbálják feltörni a saját AI ügynökeinket, még a kód élesítése előtt.

Az AI szerepe az AI önmagának biztosításában

A legérdekesebb fejlemény, hogy a legjobb fegyver az AI alapú támadások ellen maga az AI. A modern biztonsági platformok "védelmi ügynököket" (Defender Agents) telepítenek, amelyek egyetlen feladata a többi ügynök viselkedésének monitorozása és a hálózat védelme.

Ezek a védelmi ügynökök képesek megérteni a kontextust. Ha egy adatfeldolgozó ügynök egy szokatlanul komplex, obfuszkált SQL lekérdezést próbál futtatni, a védelmi ügynök (amely szintén egy LLM-re épül) képes szemantikailag elemezni a kódot, felismerni a rosszindulatú szándékot, és blokkolni a végrehajtást, mindezt ezredmásodpercek alatt.

Ellenálló AI infrastruktúra építése: Eszközök, technológiák és stratégiai partnerségek

Az elméleti keretek felállítása után a megvalósítás a megfelelő technológiai stack kiválasztásán múlik. Egy ellenálló AI infrastruktúra nem egyetlen "dobozos" szoftverből áll, hanem egymással integrált biztonsági rétegek komplex hálózatából.

A felhő-natív környezetekben a biztonság kódként (Security-as-Code) jelenik meg. A hozzáférési szabályzatokat, a hálózati szegmentációt és a monitorozási riasztásokat mind verziókövetett kódként kell kezelni (pl. Terraform segítségével), biztosítva a reprodukálhatóságot és az auditálhatóságot.

Kulcsfontosságú technológiák az AI ügynökök biztonságához

A PAM (Privileged Access Management) rendszerek hagyományosan a rendszergazdák jelszavait védték. A modern, AI-kész PAM megoldások képesek dinamikus titkokat (dynamic secrets) generálni az ügynökök számára, amelyek a feladat befejezése után azonnal megsemmisülnek (pl. HashiCorp Vault).

A CIEM (Cloud Infrastructure Entitlement Management) eszközök elengedhetetlenek a felhőben futó ügynökök jogosultságainak folyamatos auditálásához. Ezek a rendszerek gépi tanulást használnak a felhő-szolgáltatók (AWS, Azure) komplex IAM szabályzatainak elemzésére, és automatikusan azonosítják a túlzottan privilegizált (over-provisioned) AI fiókokat, megszüntetve a 4,5-szeres kockázati szorzót.

A speciális biztonsági szakértelem értéke

Az AI biztonság egy rendkívül új és gyorsan változó terület. A hagyományos kiberbiztonsági szakemberek gyakran nem rendelkeznek mélyreható ismeretekkel az LLM architektúrákról, a vektoradatbázisokról vagy a prompt-injektálási technikákról. Ezért a stratégiai partnerségek kialakítása kritikus fontosságú.

Egy tapasztalt AI integrátor partner nemcsak a fejlesztésben segít, hanem a "Secure by Design" (tervezéstől fogva biztonságos) elvek beépítésében is az architektúra alapjaiba, megelőzve a későbbi, költséges biztonsági incidenseket.

Következtetés: Az AI erejének biztonságos kihasználása – Stratégiai parancs

Az AI ügynökök korszaka megállíthatatlanul megérkezett. A kérdés már nem az, hogy a vállalatok alkalmazzák-e ezeket a technológiákat, hanem az, hogy képesek-e ezt biztonságosan tenni. A Teleport jelentése által azonosított 4,5-szeres kockázati szorzó egy ébresztő: a kényelem oltárán nem áldozhatjuk fel az adatbiztonságot.

A hagyományos IAM rendszerekről a Zero Trust architektúrára való áttérés, a dinamikus gép-identitások bevezetése, és a folyamatos, AI-vezérelt monitorozás mind elengedhetetlen lépések. Azok a vállalatok, amelyek ma befektetnek a robusztus AI biztonsági infrastruktúrába, nemcsak a kockázataikat minimalizálják, hanem hatalmas versenyelőnyre tesznek szert a piacon.

Készen áll az AI ügynökeinek biztonságára? Partnerünkkel a sikerért!

Ne hagyja, hogy a biztonsági aggályok lelassítsák vállalata innovációját. Az AiSolve szakértői csapata segít a legmodernebb, Zero Trust alapú adatfeldolgozó AI ügynökök tervezésében, fejlesztésében és biztonságos integrálásában. Szüntesse meg a biztonsági vakfoltokat, és maximalizálja az automatizáció ROI-ját.

Lépjen kapcsolatba velünk még ma, és kérjen egy átfogó konzultációt AI infrastruktúrájának biztonságos skálázásáról!

Gyakran Ismételt Kérdések (FAQ)

Mi az elsődleges biztonsági kockázat az adatfeldolgozó AI ügynökökkel kapcsolatban?

Az elsődleges kockázat a túlzott hozzáférési jogosultságok (over-privileging) megadása. A Teleport jelentése szerint ez 4,5-szeresére növeli a biztonsági incidensek esélyét. Ha egy ügynök kompromittálódik (pl. prompt injektálás révén), a támadó az ügynök magas szintű jogosultságaival férhet hozzá érzékeny adatbázisokhoz, megkerülve a hagyományos tűzfalakat.

Hogyan alkalmazható a Zero Trust az AI ügynökök hozzáférés-kezelésére?

A Zero Trust AI környezetben a statikus API kulcsok elhagyását és a dinamikus, rövid élettartamú tokenek (Just-In-Time access) használatát jelenti. Magában foglalja a mikroszegmentációt, az attribútum-alapú hozzáférés-vezérlést (ABAC), és a folyamatos, kontextusfüggő hitelesítést minden egyes gép-gép (M2M) tranzakció során.

Melyek egy hatékony AI ügynök biztonsági stratégia kulcselemei?

A kulcselemek közé tartozik a legkevesebb privilégium elvének szigorú betartása, a robusztus PAM és CIEM eszközök integrálása, a valós idejű anomália- és fenyegetésészlelés (LLM tűzfalak), a megváltoztathatatlan audit naplózás, valamint egy erős AI irányítási (Governance) keretrendszer létrehozása emberi felügyelettel (HITL).

Használhatók-e maguk az AI ügynökök a vállalati biztonság növelésére?

Igen, abszolút. A "Defender Agents" (védelmi ügynökök) kifejezetten a hálózat monitorozására és a többi AI ügynök viselkedésének elemzésére szolgálnak. Képesek ezredmásodpercek alatt felismerni a szemantikai anomáliákat, a prompt injektálási kísérleteket, és automatikusan blokkolni a gyanús tranzakciókat.

Milyen gyakran kell felülvizsgálni és frissíteni az AI ügynökök hozzáférési szabályzatait?

A felülvizsgálatnak folyamatosnak és automatizáltnak kell lennie. A CIEM eszközök segítségével a jogosultságokat valós időben kell auditálni. Bármilyen infrastrukturális változás, új adatbázis integrációja, vagy az ügynök kódjának frissítése (CI/CD pipeline során) azonnali, automatizált policy-felülvizsgálatot kell, hogy indítson.

Milyen szabályozási megfelelőségi kihívásokat jelentenek az adatfeldolgozó AI ügynökök?

A fő kihívások a GDPR és hasonló adatvédelmi törvények (pl. HIPAA) betartása. Az autonóm adatgyűjtés sértheti az adatminimalizálás elvét. Biztosítani kell a "felejtés jogát", ami technikailag nehéz a vektoradatbázisokban és LLM memóriákban. A transzparencia és a döntések megmagyarázhatósága (Explainable AI) szintén alapvető jogi követelmény.

Lehetséges-e teljes automatizációt elérni az AI ügynökökkel a biztonság veszélyeztetése nélkül?

Bár a technológia rohamosan fejlődik, a kritikus üzleti és pénzügyi folyamatokban a 100%-os autonómia jelenleg túl nagy kockázatot jelent. A "Secure by Design" elvek, a Zero Trust és a "Human-in-the-Loop" (HITL) jóváhagyási pontok kombinációja biztosítja a legmagasabb szintű automatizációt, miközben fenntartja az elengedhetetlen biztonsági kontrollt.

Készen állsz a saját weboldaladra?

Ingyenes konzultáció során átbeszéljük, hogyan segíthetünk vállalkozásodnak növekedni egy modern, gyors és konverzióoptimalizált weboldallal. 14 nap alatt kész, 0 Ft induló költséggel.