Bevezetés: Az adatrobbanás és az AI adatfeldolgozó ügynökök korszaka

Amikor az OpenAI elindította a ChatGPT-t, a világ egyik leggyorsabban növekvő fogyasztói alkalmazását hozta létre. A háttérben azonban nem csupán a nyelvi modellek (LLM-ek) varázslata zajlott, hanem egy brutális infrastruktúra-harc is. A rendszernek másodpercenként több millió lekérdezést kellett kezelnie, és ehhez az OpenAI mérnökei egy meglepően hagyományos, mégis végletekig optimalizált megoldáshoz nyúltak: a PostgreSQL-hez.

Ez a hír alapvető fontosságú minden vállalat számára, amely AI adatfeldolgozó ügynökök (AI Data Processing Agents) bevezetését tervezi. A mai adatrobbanás közepette már nem elég az adatokat tárolni; azokat valós időben kell értelmezni, tisztítani és cselekvéssé alakítani. Az AI-ügynökök éppen ezt teszik: autonóm módon „rágják át” magukat a terabyte-nyi információn, hogy üzleti értéket teremtsenek.

De van egy bökkenő: egy AI-ügynök csak annyira okos, amennyire az alatta lévő adatarchitektúra gyors és megbízható. Ha az adatbázis lassú, az ügynök „dadogni” fog. Ebben a cikkben feltárjuk, hogyan építheti fel saját, skálázható adatökoszisztémáját az OpenAI tapasztalatai alapján.

Mik azok az AI adatfeldolgozó ügynökök és miért van rájuk szükség?

Az AI adatfeldolgozó ügynökök nem egyszerű szkriptek vagy hagyományos ETL (Extract, Transform, Load) folyamatok. Ezek olyan intelligens szoftverentitások, amelyek képesek autonóm döntéseket hozni az adatfolyamok kezelése során. Míg egy hagyományos szkript leáll, ha váratlan adatformátummal találkozik, egy AI-ügynök képes elemezni a hibát, megpróbálni kijavítani az adatot, vagy alternatív útvonalat keresni.

Definíció:

Az AI adatfeldolgozó ügynök egy olyan autonóm rendszer, amely LLM-ek és gépi tanulási algoritmusok segítségével végzi az adatok begyűjtését, tisztítását, transzformációját és elemzését, minimális emberi beavatkozással.

A gyakorlatban ezek az ügynökök forradalmasítják az iparágakat. Például a biogyártásban képesek valós időben monitorozni a fermentációs folyamatokat, és beavatkozni, ha a paraméterek eltérnek az optimálistól. Pénzügyi területen az adatfeldolgozó AI-ügynökök másodpercek alatt fésülnek át milliónyi tranzakciót csalások után kutatva, sokkal nagyobb pontossággal, mint a szabályalapú rendszerek.

Az AI ügynökök láthatatlan gerince: Miért kritikus a skálázható adatarchitektúra?

Képzeljünk el egy szuperintelligens AI-ügynököt, amely képes lenne megoldani a vállalat legbonyolultabb logisztikai problémáit is. Most képzeljük el, hogy ez az ügynök minden egyes kérdésére 5 másodpercet vár az adatbázis válaszára. A rendszer használhatatlanná válik.

Az AI-ügynökök „adatéhesek”. A RAG (Retrieval-Augmented Generation) rendszerek például folyamatosan vektoros kereséseket futtatnak, miközben relációs adatbázisokból hívnak le metaadatokat. Ha az infrastruktúra nem skálázható, a következő problémák lépnek fel:

- Magas látencia: A chatbotok és ügynökök lassúvá válnak, rontva a felhasználói élményt.

- Adatkonzisztencia hibák: A túlterhelt adatbázisok írási hibákat ejthetnek, ami „hallucinációkhoz” vezet az AI válaszaiban.

- Költségrobbanás: A nem optimalizált lekérdezések feleslegesen pörgetik a felhő-számlákat.

Kulcsfontosságú tanulság:

Az AI-projektek 80%-a nem az AI-modellek hiányosságai, hanem az elégtelen adatarchitektúra miatt bukik el. A skálázhatóság nem utólagos extra, hanem előfeltétel.

AI Ügynök -> Feldolgozott adat" class="w-full h-auto object-cover max-h-[500px] rounded-lg mb-8 shadow-lg">

AI Ügynök -> Feldolgozott adat" class="w-full h-auto object-cover max-h-[500px] rounded-lg mb-8 shadow-lg">

OpenAI PostgreSQL Skálázási Tervrajz a ChatGPT-hez: Tanulságok az iparág számára

Az OpenAI nemrégiben betekintést engedett abba, hogyan kezelték a ChatGPT robbanásszerű növekedését. A válasz nem egy új, divatos NoSQL adatbázis volt, hanem a PostgreSQL okos skálázása. Ez a „tervrajz” minden vállalati mérnök számára kötelező olvasmány.

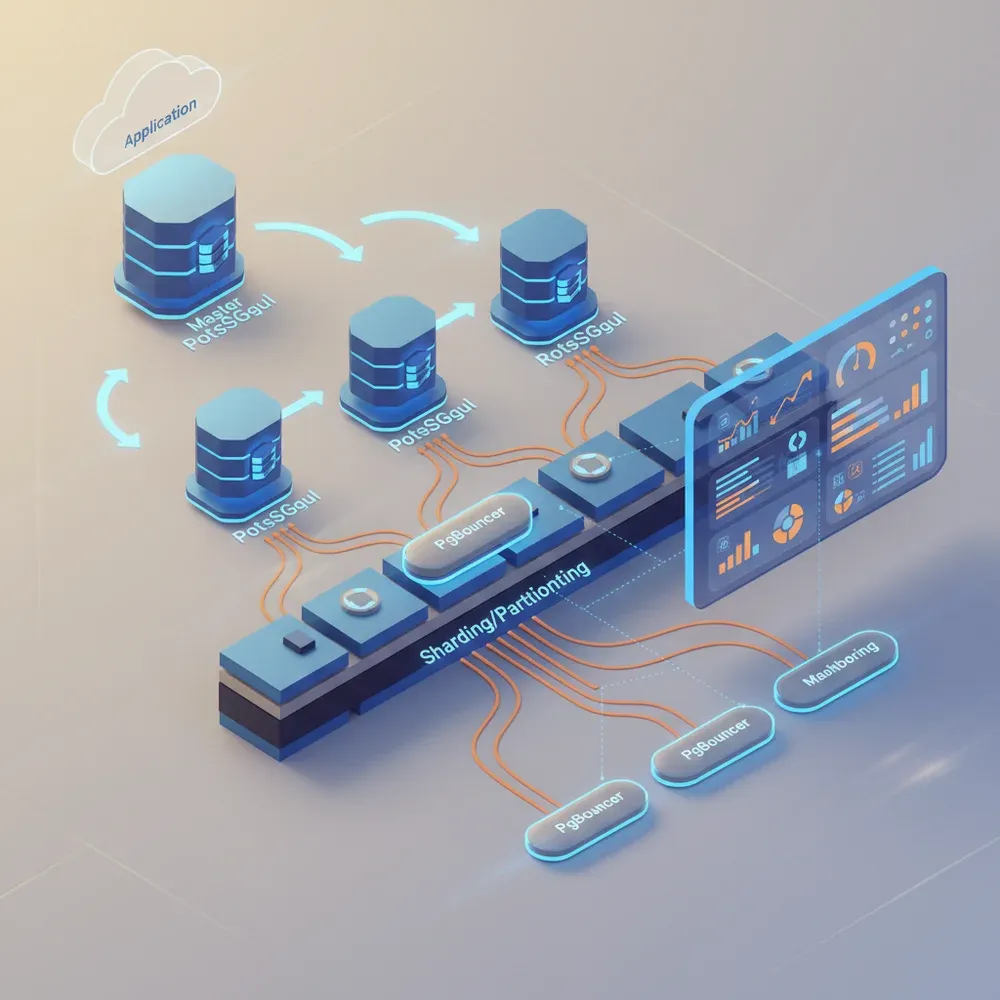

Architekturális döntések a nagy átviteli sebességért

A legfontosabb lépés a sharding (adatdarabolás) és a partitioning (particionálás) bevezetése volt. Az egyetlen hatalmas adatbázis helyett az adatokat logikai egységekre bontották, így az írási terhelés megoszlik több szerver között. Ezen felül a PgBouncer használata kritikus volt a kapcsolatok kezelésében (connection pooling). Ahelyett, hogy minden egyes API-hívás új kapcsolatot nyitna az adatbázishoz (ami hatalmas overhead), a PgBouncer fenntart egy medencényi nyitott kapcsolatot, és ezeket osztja ki villámgyorsan.

Lekérdezés-optimalizálás és indexelési stratégiák

Az AI-ügynökök gyakran komplex JSON adatokat tárolnak (pl. beszélgetési előzmények, metaadatok). Az OpenAI intenzíven használja a PostgreSQL JSONB típusát, kombinálva a GIN (Generalized Inverted Index) indexekkel. Ez lehetővé teszi, hogy a strukturálatlan adatokban is olyan gyorsan keressenek, mintha azok hagyományos táblákban lennének. Ez a technika elengedhetetlen a RAG chatbotok hatékony működéséhez.

Megfigyelhetőség és teljesítményhangolás

Nem lehet javítani azt, amit nem mérünk. Az OpenAI mérnökei részletes metrikákat gyűjtöttek a lekérdezések futási idejéről (pg_stat_statements), a zárolásokról (locks) és a várakozási eseményekről. Ez a proaktív monitorozás tette lehetővé, hogy még azelőtt beavatkozzanak, mielőtt a felhasználók lassulást érzékeltek volna.

Az OpenAI skálázási stratégiáinak adaptálása vállalati környezetben

Bár a legtöbb vállalatnak nincs szüksége a ChatGPT szintű skálázásra, az elvek ugyanazok. Hogyan ültetheti át ezeket a gyakorlatba?

Legjobb gyakorlatok (Best Practices):

- Ne kezdjen shardinggal: A legtöbb esetben a vertikális skálázás (erősebb hardver) és az olvasási replikák (Read Replicas) használata évekig elegendő. A sharding bonyolulttá teszi az üzemeltetést.

- Használjon Connection Poolert: A PgBouncer vagy az AWS RDS Proxy bevezetése az egyik legegyszerűbb módja a teljesítmény növelésének nagy terhelés alatt.

- Automatizált karbantartás: A

VACUUMfolyamatok finomhangolása kritikus, hogy az adatbázis ne „fulladjon be” a törölt sorok (dead tuples) miatt.

Ha az Ön vállalata egyedi automatizálási megoldásokat épít, érdemes már a tervezési fázisban figyelembe venni ezeket az elveket, hogy elkerülje a későbbi, fájdalmas migrációkat.

AI-kész adatarchitektúra tervezése: A PostgreSQL-en túl

Bár a relációs adatbázis a gerinc, egy modern AI-ökoszisztéma több elemből áll. Az AI adatfeldolgozó ügynökök gyakran igényelnek speciális tárolókat:

- Vektoradatbázisok (Vector DBs): A Pinecone, Weaviate vagy a pgvector kiegészítő elengedhetetlen a szemantikus kereséshez és a RAG architektúrákhoz.

- Data Lakes (Adattavak): Az S3 vagy Azure Blob Storage tárolja a nyers, strukturálatlan adatokat (képek, PDF-ek), amelyeket az ügynökök dolgoznak fel.

- Stream Processing: Az Apache Kafka vagy a Redpanda biztosítja, hogy az adatok valós időben jussanak el az ügynökökhöz, ne pedig éjszakai kötegelt (batch) feldolgozással.

Ez a hibrid megközelítés teszi lehetővé, hogy például egy AI telefonos ügyfélszolgálat azonnal hozzáférjen a hívó fél legfrissebb rendelési adataihoz (SQL), miközben a tudásbázisból releváns válaszokat keres (Vektor DB).

AI adatfeldolgozó ügynökök implementálása: Gyakorlati útmutató

A technológia adott, de hogyan vágjunk bele? Íme egy lépésről-lépésre útmutató.

Adatgyűjtés és előfeldolgozás

Az első lépés az adatforrások feltérképezése. Használjon modern ETL eszközöket (pl. Airbyte, Fivetran), hogy az adatokat egy központi helyre terelje. Itt lépnek be az első „tisztító ügynökök”, amelyek normalizálják az adatokat.

Ügynökfejlesztés és képzés

Válassza ki a megfelelő keretrendszert (pl. LangChain, AutoGen). Ne próbáljon meg egyetlen „mindentudó” ügynököt építeni. Helyette hozzon létre specializált ügynököket: egyet a pénzügyi adatokhoz, egyet a logisztikához. Ez a modularitás növeli a pontosságot és a karbantarthatóságot.

Telepítés és orchestráció

Az ügynökök futtatásához szükség van egy orchestrációs rétegre (pl. Kubernetes, Temporal). Ez biztosítja, hogy ha egy ügynök elakad, a rendszer újraindítsa, vagy riasztást küldjön. A Spark optimalizáció például kritikus lehet, ha nagy mennyiségű adatot kell párhuzamosan feldolgozni.

Adatbiztonság és megfelelőség biztosítása az AI ügynökök számára

Az autonómia kockázattal jár. Ha egy ügynök hozzáfér a teljes adatbázishoz, mi akadályozza meg abban, hogy érzékeny adatokat szivárogtasson ki? A biztonság nem lehet utógondolat.

Figyelem:

Soha ne adjon „admin” jogosultságot egy AI-ügynöknek! Alkalmazza a legkisebb jogosultság elvét (Least Privilege Principle). Az ügynökök csak azokhoz a táblákhoz férjenek hozzá, amelyek a feladatukhoz feltétlenül szükségesek.

Különösen a kritikus rendszerekben fontos az audit naplózás. Minden döntést, amit az AI hoz, vissza kell tudni követni: milyen adatok alapján, mikor és miért döntött úgy, ahogy.

Az AI adatfeldolgozás jövője: Trendek és innovációk

A jövő az „Edge AI” és a valós idejű feldolgozás felé mutat. Ahelyett, hogy minden adatot a felhőbe küldenénk, az ügynökök közvetlenül az eszközökön (pl. IoT szenzorok, mobiltelefonok) végzik el az előfeldolgozást. Ez drasztikusan csökkenti a sávszélesség-igényt és a látenciát.

Egy másik izgalmas trend az „Autonomous Data Pipelines”, ahol az ügynökök maguk építik és javítják az adatcsővezetékeket. Ha megváltozik a forrásadat formátuma, az ügynök automatikusan frissíti a transzformációs logikát, anélkül, hogy a mérnököknek éjszaka fel kellene kelniük.

Kihívások és gyakori buktatók az AI adatarchitektúrában

A leggyakoribb hiba a „túltervezés”. Sok vállalat azonnal a legbonyolultabb mikro-szerviz architektúrát és a legújabb vektoradatbázist akarja bevezetni, miközben az alapvető adatminőségi problémáikat sem oldották meg. A „szemét be, szemét ki” elve az AI-nál hatványozottan igaz.

Egy másik buktató a költségek alulbecslése. A vektoros keresések és az LLM API hívások drágák lehetnek. Fontos a költségkontroll (FinOps) bevezetése már a projekt elején.

Következtetés: Építse fel jövőbiztos AI adatökoszisztémáját

Az OpenAI példája megmutatta, hogy a siker kulcsa nem mindig a legújabb technológia, hanem a meglévő eszközök (mint a PostgreSQL) mesteri szintű alkalmazása és skálázása. Az AI adatfeldolgozó ügynökök hatalmas versenyelőnyt jelentenek, de csak akkor, ha stabil alapokra építkeznek.

Ne várja meg, amíg rendszerei összeomlanak a terhelés alatt. Kezdje el ma az adatarchitektúrája modernizálását, és készítse fel vállalatát az autonóm jövőre.

Segítségre van szüksége az induláshoz? Az AiSolve szakértői csapata segít megtervezni és kivitelezni az Ön igényeire szabott, skálázható AI-infrastruktúrát.

![30 GYIK az AI Webfejlesztésről — Amit Minden Vállalkozónak Tudni Kell [2026]](/_next/image?url=%2Fimages%2Fblog%2Fai-webfejlesztes-gyik-2026.webp&w=3840&q=75)