| Terület | Kulcsfontosságú Megállapítás |

|---|---|

| Alapprobléma | A standard AI modellekből hiányzik a "kontextuális integritás", ami anonimizált adatok esetén is adatszivárgáshoz vezethet. A kihívás megtanítani az AI-nak, hogy ne csak azt értse, *mik* az adatok, hanem azt is, *hogyan* kellene őket felhasználni adott kontextusban. |

| A Microsoft megoldása | A Microsoft egy kettős megközelítést mutatott be: a PrivacyChecker-t, egy valós idejű következtetési pajzsot, és a CI-CoT + CI-RL-t, egy fejlett képzési módszert, amely megtanítja a modelleket az adatvédelmi szabályok proaktív értelmezésére. |

| Üzleti hatás | Ezen technológiák bevezetése kulcsfontosságú a szabályozási megfelelés (GDPR, CCPA) szempontjából, a márka hírnevét rontó adatszivárgások elkerülésében, és az ügyfélbizalom kiépítésében egy AI-vezérelt piacon. |

| Implementáció | A vállalatok integrálhatják ezeket az adatvédelmi rétegeket egyedi automatizálási és adatfeldolgozási munkafolyamataikba, így AI ügynökeik biztonságosabbá és megbízhatóbbá válnak érzékeny információk kezelésében. |

| Jövőbeli kilátások | A vállalati AI jövője nem csak a képességekről, hanem az irányításról is szól. A proaktív, tanítható adatvédelmi keretrendszerek a vállalati AI telepítések standard követelményévé válnak. |

A Nagy Nyelvi Modellek (LLM-ek) elterjedése minden üzleti szektorban üstökösszerű volt. Az ügyfélszolgálattól az adatelemzésig ezek az MI-rendszerek soha nem látott hatékonyságot ígérnek. Ez a gyors adoptáció azonban egy kritikus sebezhetőségre is rávilágított: a robusztus, kontextus-érzékeny adatvédelmi kontrollok riasztó hiányára. Egy friss jelentés szerint az MI-t alkalmazó vállalatok több mint 60%-a alacsony magabiztossággal rendelkezik az adatvédelmi és megfelelési kockázatok kezelésében. Ez nem csupán technikai probléma; ez egy ketyegő időzített bomba a vállalati hírnév és a szabályozási megfelelés szempontjából. A hagyományos adatvédelmi módszerek, mint az anonimizálás, elégtelennek bizonyulnak azokkal a kifinomult módokkal szemben, ahogyan az LLM-ek képesek érzékeny információkat kikövetkeztetni és felfedni. A probléma gyökere a "kontextuális integritásban" rejlik – az MI képességében, hogy megértse, az adatok megosztásának helyénvalósága teljes mértékben a helyzettől függ.

Ennek a kihívásnak a megoldása felé tett jelentős lépésként a Microsoft Research bemutatott egy úttörő, kettős megközelítést, amelynek célja a kifinomult adatvédelmi érvelés közvetlen beágyazása az MI-modellekbe. Megoldásuk a PrivacyChecker nevű könnyűsúlyú, valós idejű adatvédelmi pajzsból, valamint a CI-CoT + CI-RL nevű újszerű képzési módszertanból áll. Ez a fejlesztés túllép az egyszerű kulcsszószűrésen, és olyan MI létrehozását célozza, amely belsőleg érti és tiszteletben tartja az adatok kontextuális határait. Ez a cikk részletesen elemzi ezeket az innovatív technológiákat, feltárja mélyreható következményeiket a vállalati szintű MI-telepítésekre, és stratégiai útmutatót nyújt az integrálásukhoz. Megvizsgáljuk, hogyan alakíthatják át ezek az eszközök a standard MI-modelleket rendkívül biztonságos adatfeldolgozó AI ügynökökké, amelyek képesek eligazodni a modern adatvédelmi szabályozások bonyolult hálójában és megóvni az érzékeny vállalati információkat.

A kontextuális adatvédelem egyre súlyosabb válsága a mesterséges intelligenciában

Éveken keresztül az adatvédelem fő fókusza az adatok tárolás közbeni és átvitel alatti biztonságán volt – a titkosítás, a hozzáférés-szabályozás és az anonimizálás voltak a bevett eszközök. A generatív MI felemelkedése azonban egy sokkal alattomosabb és veszélyesebb fenyegetést hozott magával: a kontextuális integritás megsértését. A kontextuális integritás az az elv, hogy az információkat csakis annak a specifikus kontextusnak a normái szerint szabad felhasználni és megosztani, amelyben gyűjtötték őket. Például egy páciens megosztja kórtörténetét egy orvossal diagnosztikai céllal; ez a kontextus sérül, ha az orvos egy nyilvános kávézóban beszéli meg az esetet, még akkor is, ha a páciens nevét nem említi. Az LLM-ek, amelyeket hatalmas, differenciálatlan, nyilvános internetes adathalmazokon képeztek, nem rendelkeznek veleszületett képességgel ezen társadalmi és szakmai határok megértésére.

Ez olyan helyzetekhez vezet, ahol egy MI akaratlanul is adatvédelmi incidenst okozhat látszólag anonim adatpontok összekapcsolásával. Egy MI-alapú HR asszisztens például megkérhető a teljesítményértékelések összefoglalására. Bár neveket nem fed fel, összekapcsolhat projektadatokat, határidőket és visszajelzéseket oly módon, hogy a kollégák számára könnyen azonosíthatóvá váljon az értékelt munkavállaló. Ez a kontextuális integritás klasszikus hibája. Az MI tényszerűen helyes adatokat dolgozott fel, de nem értette meg egy belső teljesítményértékelés implicit adatvédelmi normáit. Ezeket a finom jogsértéseket hihetetlenül nehéz megelőzni hagyományos, szabályalapú rendszerekkel, mivel a lehetséges kontextusok száma szinte végtelen. Ezért az okosabb, kontextust értelmezni képes adatfeldolgozó AI ügynökök építése már nem luxus, hanem a vállalati MI alapvető szükséglete.

Miért vall kudarcot a standard anonimizálás?

A standard anonimizálási technikák alapvető korlátja, hogy a Személyazonosításra Alkalmas Információk (PII), mint a nevek, címek és társadalombiztosítási számok eltávolítására összpontosítanak. Azonban gyakran hátrahagynak "kvázi-azonosítókat". Ezek olyan információk, amelyek önmagukban nem egyediek, de kombinálva újraazonosíthatnak egy személyt. Vegyünk egy adathalmazt, amely tartalmazza egy alkalmazott osztályát, beosztását és a céghez való csatlakozásának hónapját. Külön-külön ezek az adatok anonimak. De egy 500 fős cégnél ezek elegendőek lehetnek egyetlen személy beazonosításához. Az LLM-ek kivételesen jók ezen mintázatok megtalálásában és az összefüggések felismerésében, gyakorlatilag visszafordítva az anonimizálási folyamatot anélkül, hogy erre kifejezetten utasítást kaptak volna. Ezt a kihívást célozzák meg a Microsoft új eszközei.

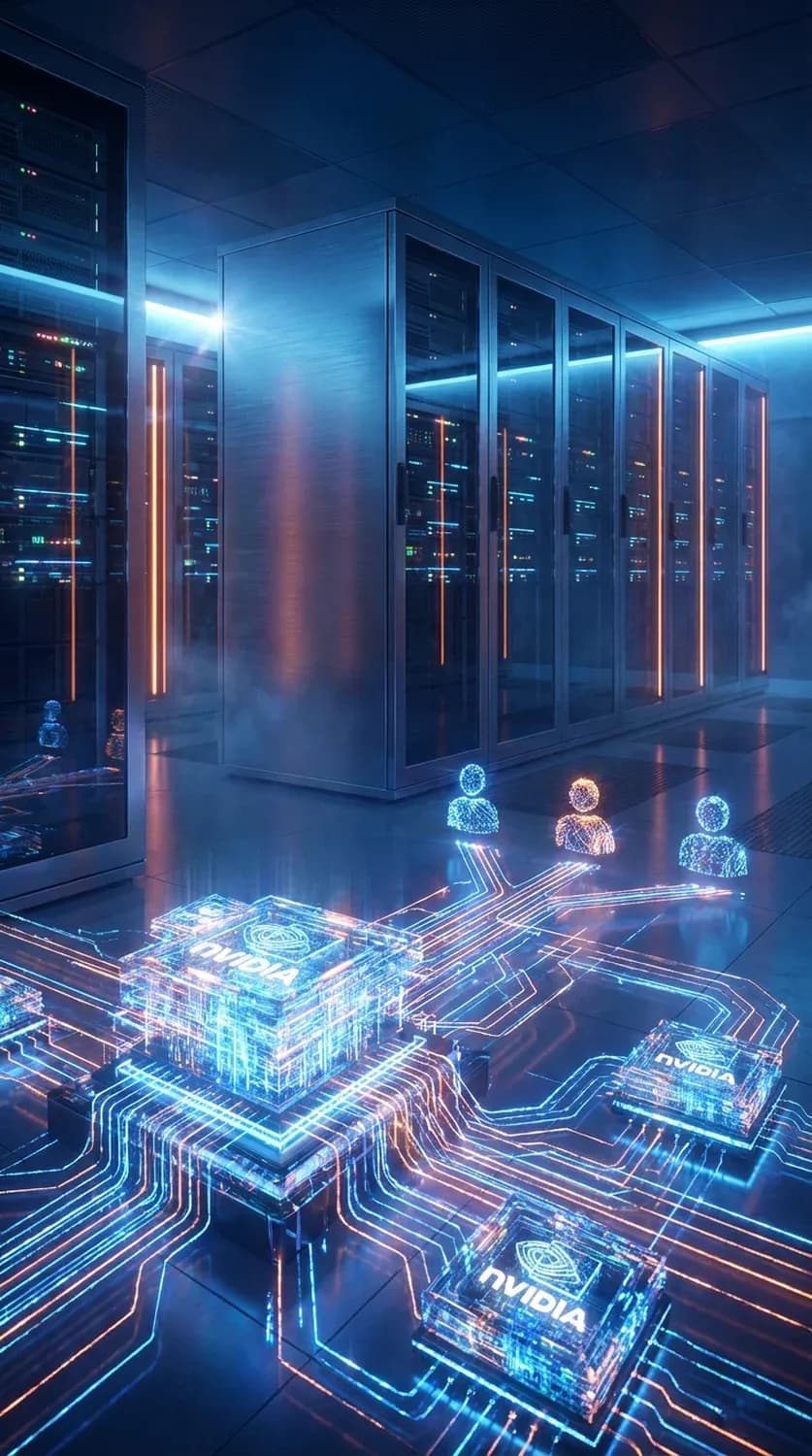

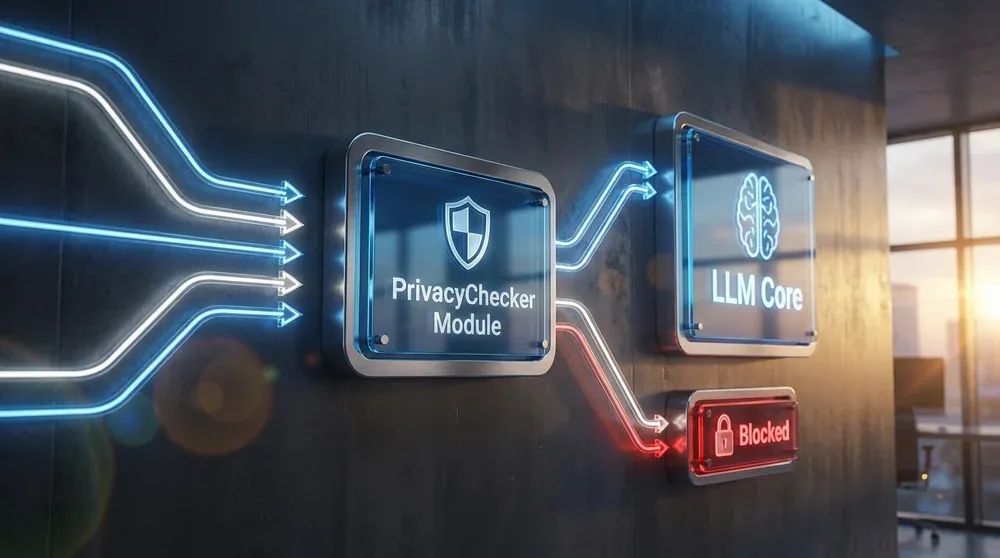

A Microsoft első védelmi vonala: a PrivacyChecker modul

A Microsoft első innovációja, a PrivacyChecker, egy nyílt forráskódú, könnyűsúlyú modul, amelyet arra terveztek, hogy "adatvédelmi pajzsként" működjön a következtetési fázisban. A következtetés az a szakasz, amikor egy betanított MI-modellt aktívan használnak lekérdezések megválaszolására vagy tartalom generálására. Gondoljunk a PrivacyChecker-re úgy, mint egy intelligens kapuőrre, amely a felhasználói parancs és az LLM között helyezkedik el. Valós időben ellenőrzi mind a parancsot, mind az MI lehetséges válaszát, hogy biztosítsa azok megfelelését az előre meghatározott kontextuális adatvédelmi irányelveknek, mielőtt a végleges kimenet a felhasználóhoz kerül. Ez a megközelítés azért hatékony, mert nem igényli a teljes LLM újratanítását, így viszonylag gyors és költséghatékony módja a biztonsági réteg hozzáadásának a meglévő MI-rendszerekhez.

A modul egy konfigurálható szabályrendszeren alapul, amely meghatározza, mi minősül adatvédelmi jogsértésnek egy adott kontextusban. Egy vállalat például beállíthatja a PrivacyChecker-t egy olyan irányelvvel, hogy "az alkalmazotti teljesítményadatokat nem szabad összekapcsolni a személyes közösségi média profiljaikból származó adatokkal". Ha egy felhasználó ezután azt kéri az MI-től, hogy "Mutasd meg azoknak az alkalmazottaknak a teljesítményértékelését, akik gyakran posztolnak politikáról a nyilvános közösségi médiájukban", a PrivacyChecker elfogná ezt a lekérdezést. Azonosítaná, hogy a parancs két különböző kontextust (szakmai teljesítmény és személyes közösségi média) próbál összekötni, és letiltaná a lekérdezést, megakadályozva, hogy az LLM egyáltalán megpróbálja feldolgozni a nem megfelelő kérést. Ez a reaktív, valós idejű validálás kulcsfontosságú első lépés a biztonságosabb MI bevezetésében. Ezen komplex szabályrendszerek hatékony kezelése gyakran egyértelmű és intuitív felhasználói felületet igényel, ami aláhúzza a professzionális weboldal készítés fontosságát nemcsak a nyilvános oldalak, hanem a belső menedzsment felületek esetében is.

Megvalósítási javaslat: Kezdje a PrivacyChecker bevezetését belső, alacsony kockázatú MI-alkalmazásokon. Használja arra, hogy monitorozza, milyen típusú adatvédelmileg érzékeny lekérdezéseket tesznek fel a felhasználók. Ezek az adatok felbecsülhetetlenek az irányelvek finomításához, mielőtt az MI-t ügyféloldali környezetben is bevetné.

A PrivacyChecker technikai architektúrája

Lényegében a PrivacyChecker egy kisebb, specializált nyelvi modellt használ, amelyet arra finomhangoltak, hogy felismerje a lehetséges adatvédelmi jogsértéseket egy formális kontextuális integritási keretrendszer alapján. Amikor egy parancs beérkezik, először ehhez a specializált modellhez kerül, amely elemzi az említett entitások és adattípusok közötti kapcsolatokat. Olyan kéréseket keres, amelyek átlépik a szervezet irányelvei által meghatározott kontextuális határokat. Például meg tudja különböztetni az érvényes ("Összegezd az értékesítési teljesítményt régiónként") és az érvénytelen ("Melyik értékesítő él a legmagasabb jövedelmű irányítószámú körzetben?") kérést. Az előbbi az üzleti műveletekhez kapcsolódik, míg az utóbbi helytelenül kapcsolja össze a szakmai adatokat a személyes, szocioökonómiai adatokkal. Ez az architektúra lehetővé teszi a gyors elemzést anélkül, hogy jelentős késleltetést okozna, így praktikussá teszi valós alkalmazásokhoz.

Proaktív adatvédelmi tréning: A CI-CoT + CI-RL paradigma

Míg a PrivacyChecker egy alapvető reaktív pajzsot biztosít, a Microsoft második innovációja, a CI-CoT + CI-RL, proaktívan kívánja megoldani az adatvédelmi problémát. Ez egy kifinomult képzési módszertan, amelyet arra terveztek, hogy megtanítsa az LLM-et az adatvédelemről való *gondolkodásra* az alapoktól kezdve. Ahelyett, hogy csak letiltaná a rossz kéréseket, egy ezzel a módszerrel képzett MI megtanulja megérteni, *miért* lehet egy kérés helytelen, és képes megindokolni döntését. Ez hatalmas előrelépést jelent, az egyszerű szabálykövetéstől a valódi kognitív megértés felé haladva. Ez a módszer emel egy standard modellt egy valóban intelligens adatfeldolgozó AI ügynök szintjére.

A folyamat két szakaszra bontható:

- Kontextuális Integritás Láncolt Gondolkodás (CI-CoT): Ebben a szakaszban a modellt olyan példákon képzik, ahol expliciten "hangosan kell gondolkodnia" az adatvédelmi szabályokról. Megtanulja, hogy lépésről lépésre elemezzen egy parancsot, azonosítva a kontextust, az érintett szereplőket, az információ típusát és a releváns adatvédelmi normát, mielőtt választ fogalmazna meg. Például egy adott parancsra először belsőleg ilyen szöveget generálhat: "A felhasználó egy menedzser. Egy alkalmazott egészségügyi információit kéri. Ez sérti az 'orvosi titoktartás' normáját. Ezért el kell utasítanom ezt a kérést és meg kell indokolnom."

- Megerősítéses Tanulás Kontextuális Visszajelzésből (CI-RL): A kezdeti CoT képzés után a modellt megerősítéses tanulással tovább finomítják. Kétértelmű forgatókönyvekkel szembesítik, és jutalmazzák az adatvédelmet tiszteletben tartó döntésekért, büntetik pedig a jogsértésekért. Ez a finomhangolási folyamat csiszolja a döntéshozatali képességeit, robusztusabbá téve az olyan újszerű helyzetek kezelésében, amelyek nem szerepeltek expliciten a kezdeti képzési adatokban.

Egy így képzett MI nemcsak letilt egy problémás lekérdezést, hanem képes párbeszédet folytatni a felhasználóval, elmagyarázva: "Nem adhatok ki konkrét orvosi adatokat, mivel az sértené az alkalmazottak adatvédelmi jogait. Azonban tudok adni egy anonimizált összefoglalót a betegszabadságok tendenciáiról osztályonként." Ez a képesség, hogy megindokolja döntéseit, kritikus a felhasználói bizalom kiépítéséhez és valóban együttműködő, egyedi automatizálás megoldások létrehozásához, amelyek az emberi operátorokkal együtt, nem pedig ellenük dolgoznak.

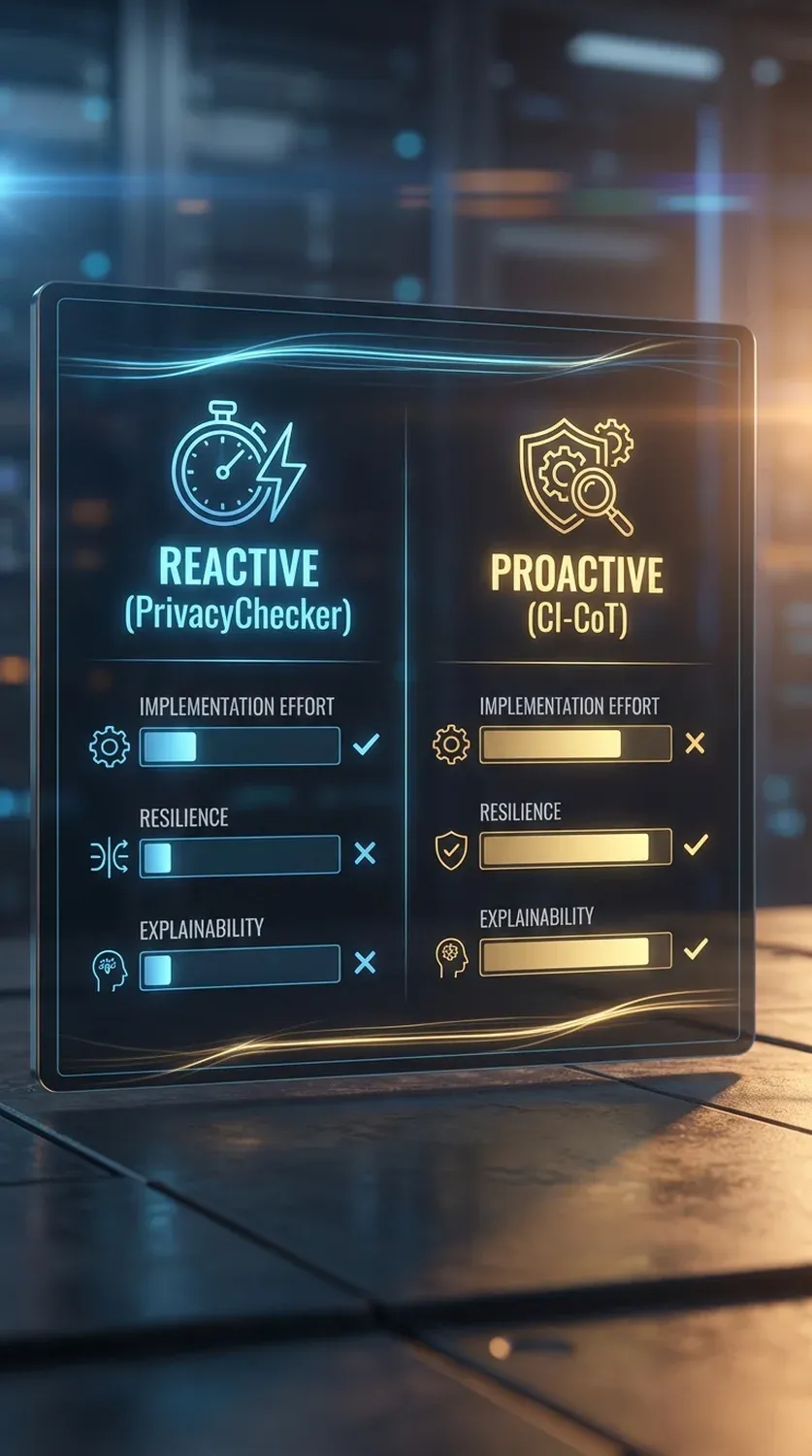

Fej-fej mellett: Reaktív vs. Proaktív AI adatvédelmi kontrollok

A reaktív (mint a PrivacyChecker) és a proaktív (mint a CI-CoT képzés) megközelítés közötti választás egy szervezet specifikus igényeitől, erőforrásaitól és kockázattűrő képességétől függ. Egy reaktív pajzs gyorsan telepíthető meglévő rendszerekre, azonnali védelmi réteget nyújtva. Kiváló megoldás olyan vállalkozások számára, amelyek már használnak harmadik féltől származó MI-modelleket, és egy irányítási réteget szeretnének hozzáadni anélkül, hogy a központi modellt módosítanák. Azonban kapuőrként működik, és néha kijátszható ügyesen megfogalmazott parancsokkal. Hatékonysága teljes mértékben az előre definiált szabályrendszer minőségétől és teljességétől függ.

Egy proaktívan képzett modell ezzel szemben eredendően biztonságosabb. Az adatvédelem be van építve a döntéshozatali folyamatába. Ez a megközelítés ellenállóbb az újszerű vagy rosszindulatú parancsokkal szemben, mert a modell nem csak szabályokat ellenőriz, hanem alapelvekből kiindulva érvel. A hátránya a képzésbe és finomhangolásba fektetett jelentős kezdeti beruházás. Ez általában jobb hosszú távú stratégia olyan szervezetek számára, amelyek saját modelleket fejlesztenek, vagy rendkívül érzékeny adatokat kezelnek, például az egészségügyben vagy a pénzügyi szektorban. Sok vállalkozás számára valószínűleg egy hibrid megközelítés lesz a leghatékonyabb: egy proaktívan képzett modellt használnak központi motorként, és egy reaktív pajzsot, mint a PrivacyChecker, végső biztonsági hálóként és audit rétegként. Ez a kettős stratégia az arany standard a vállalati szintű adatfeldolgozó AI ügynökök építésében.

Ábra: A reaktív és proaktív MI adatvédelmi mechanizmusok kulcsjellemzőinek összehasonlítása.

| Jellemző | Reaktív Kontroll (PrivacyChecker) | Proaktív Kontroll (CI-CoT + CI-RL) |

|---|---|---|

| Implementációs erőfeszítés | Alacsony. Meglévő modellek köré épített rétegként telepíthető. | Magas. Mély modell-finomhangolást vagy alapoktól való képzést igényel. |

| Rugalmasság | Magas. Az irányelvek valós időben frissíthetők a központi LLM újratanítása nélkül. | Alacsony. Az adatvédelmi filozófia változásai jelentős újratanítást igényelhetnek. |

| Ellenállás újszerű fenyegetésekkel szemben | Mérsékelt. A szabályrendszer teljességétől függ. | Magas. Képes érvelni olyan új forgatókönyvekről, amelyeket nem látott a képzés során. |

| Teljesítményterhelés | Alacsony. Minimális késleltetést ad a következtetési folyamathoz. | Elhanyagolható következtetéskor, de magas számítási költség a képzés során. |

| Magyarázhatóság | Korlátozott. Meg tudja mondani, melyik szabály sérült, de a mélyebb "miért"-et nem. | Magas. Képes természetes nyelven magyarázatot adni adatvédelmi döntéseiről. |

| Legjobb felhasználás | Adatvédelmi kontrollok gyors utólagos hozzáadása meglévő MI-rendszerekhez. | Új, eredendően biztonságos modellek építése rendkívül érzékeny adatok kezelésére. |

Navigáció a megfelelőségi labirintusban: GDPR, CCPA és azon túl

Ezeknek a fejlett adatvédelmi eszközöknek a fejlesztése nem vákuumban történik. Közvetlen válasz egy egyre szigorodó globális szabályozási környezetre. Az olyan szabályozások, mint az EU Általános Adatvédelmi Rendelete (GDPR) és a Kaliforniai Fogyasztói Adatvédelmi Törvény (CCPA), súlyos büntetéseket szabnak ki adatszivárgások és a személyes adatokkal való visszaélés esetén. Ezen szabályozások egyik kulcsfontosságú alapelve a "Beépített és Alapértelmezett Adatvédelem", amely előírja, hogy a szervezeteknek már a tervezés legelején figyelembe kell venniük az adatvédelmet. A proaktív képzési módszerek, mint a CI-CoT + CI-RL, tökéletesen megtestesítik ezt az elvet. Azáltal, hogy az adatvédelmi tudatosságot magába a modellbe építik, a vállalatok könnyebben bizonyíthatják a szabályozó hatóságok felé, hogy robusztus technikai intézkedéseket tettek a felhasználói adatok védelmére.

Stratégiai tipp: Használja a proaktívan képzett modellek "magyarázhatósági" funkcióját a megfelelési dokumentáció részeként. Az MI által generált indoklás arról, hogy miért tartott vissza információt, erőteljes audit nyomvonalként szolgálhat, bizonyítva a hatóságoknak, hogy rendszere aktívan hoz adatvédelmileg tudatos döntéseket.

Ezenkívül ezek az eszközök segítenek a "felejtéshez való jog" és az "adattakarékosság" elveinek kezelésében. Egy kontextus-érzékeny MI jobban azonosítja és elkülöníti azokat az adatokat, amelyekre már nincs szükség az eredeti céljukhoz, így könnyebb őket törölni a felhasználó kérésére. Például egy ilyen elvekkel épített RAG AI chatbot megérthetné, hogy bár szüksége van a felhasználó címére egy aktuális rendelés feldolgozásához, ezt az információt utána nem szabad általános ügyfélprofilozásra megőriznie. Az ilyen árnyalatokat értő, kifinomult adatfeldolgozó AI ügynökök bevetése válik a leghatékonyabb móddá a folyamatos megfelelés biztosítására és a több millió dolláros bírságok elkerülésére.

Az adatvédelmet előtérbe helyező AI integrálása a vállalati stratégiába

A PrivacyChecker-hez hasonló eszközök és a CI-CoT-hoz hasonló képzési módszerek elérhetősége azt jelenti, hogy a vállalkozásoknak már nincs mentségük arra, hogy megfelelő adatvédelmi biztosítékok nélkül telepítsenek MI-t. Ezen technológiák integrációjának minden vállalati MI-stratégia központi elemévé kell válnia. Az ügyfélszolgálatban MI-t alkalmazó cégek számára ez azt jelenti, hogy rendszereiket egy biztonságos AI telefonos ügyfélszolgálattá vagy chatbottá fejlesztik, amely képes felismerni és védeni a beszélgetések során megosztott személyes adatokat. A marketing és értékesítés területén dolgozók számára ez olyan adatfeldolgozó AI ügynökök építését jelenti, amelyek képesek elemezni az ügyféltrendeket anélkül, hogy megsértenék az egyéni adatvédelmi normákat.

Az első lépés az adatok feltérképezése és az irányelvek meghatározása. A vállalkozásoknak azonosítaniuk kell azokat a különböző kontextusokat, amelyekben adatokat kezelnek (pl. ügyfélszolgálat, pénzügyi tranzakciók, HR értékelések), és egyértelmű adatvédelmi szabályokat kell definiálniuk mindegyikhez. Ezek az irányelvek válnak a PrivacyChecker-t működtető szabálykönyvvé vagy egy CI-CoT modell képzési adatává. Ez a folyamat a jogi, megfelelőségi és műszaki csapatok együttműködését igényli. A végső cél egy olyan automatizált rendszerekből álló ökoszisztéma létrehozása, ahol az adatvédelem nem utólagos gondolat, hanem alapvető komponens. Ezeket a rendszereket monitorozni és auditálni kell, ami robusztus belső eszközöket igényel. Egy jól megtervezett kezelőfelület, amelyet gyakran professzionális weboldal készítés során fejlesztenek, elengedhetetlen ahhoz, hogy a megfelelőségi tisztek valós időben, világos képet kapjanak arról, hogyan értelmezi és érvényesíti az MI az adatvédelmi irányelveket.

Egy fázisos integrációs megközelítés

A legtöbb szervezet számára egy fázisos megközelítés a legpraktikusabb.

- 1. fázis: Audit és védelem. Telepítsen egy PrivacyChecker-hez hasonló eszközt a meglévő MI-alkalmazásokra csak monitorozó módban, hogy megértse a jelenlegi adatvédelmi kockázatokat. Ezután aktiválja a védelmi funkcióit, hogy azonnali védelmi réteget biztosítson.

- 2. fázis: Egy központi, adatvédelmileg tudatos modell fejlesztése. Indítsa el egy dedikált LLM finomhangolásának folyamatát a CI-CoT + CI-RL módszertan segítségével. Kezdje egy specifikus, magas kockázatú területtel, mint a HR vagy az ügyfélpénzügyi adatok. Ez a modell lesz a belső "adatvédelmi szakértője".

- 3. fázis: Skálázás és föderáció. Ahogy a központi modell érik, használja azt minden érzékeny adatlekérdezés kezelésére a szervezetben. Más, kevésbé specializált AI ügynökök konzultálhatnak ezzel a központi modellel, ha potenciálisan érzékeny kéréssel találkoznak, létrehozva egy központ-küllő alapú irányítási architektúrát. Ez lehetővé teszi, hogy a nagy teljesítményű, biztonságos adatfeldolgozó AI ügynököket központi szolgáltatásként használja.

Az új adatvédelmi eszközök kockázatainak és korlátainak megértése

Bár a Microsoft innovációi jelentős előrelépést jelentenek, nem csodaszerek. A vállalkozásoknak kulcsfontosságú megérteniük korlátaikat, hogy elkerüljék a hamis biztonságérzetet. A PrivacyChecker hatékonysága például teljes mértékben a neki adott szabályok minőségétől függ. A rosszul definiált vagy hiányos adatvédelmi irányelvek porózus pajzsot eredményeznek. A rosszindulatú szereplők folyamatosan új módszereket keresnek a parancsok megfogalmazására, hogy kijátsszák ezeket a szabályokat – ez egy macska-egér játék, amit adverzariális támadásnak neveznek. A szervezeteknek el kell kötelezniük magukat az irányelveik folyamatos frissítése és finomítása mellett a felmerülő fenyegetésekre válaszul.

A proaktívan képzett modellek esetében a fő kockázat a "normatív eltolódás". Az adatvédelem társadalmi vagy szervezeti normái idővel változhatnak. Egy mai adatvédelmi normákkal képzett modell néhány év múlva helytelen döntéseket hozhat, ha nem képzik újra vagy finomhangolják rendszeresen frissített etikai iránymutatásokkal. Továbbá fennáll a "túlkorrekció" veszélye is, ahol az MI túl óvatossá válik, és megtagadja a jogos, nem érzékeny lekérdezések megválaszolását, ezzel akadályozva az üzleti működést. A biztonság és a hasznosság közötti megfelelő egyensúly megtalálása folyamatos teljesítmény-monitorozást és beállítást igényel. Ezek az eszközök jelentősen csökkentik a kockázatot, de nem szüntetik meg az emberi felügyelet és egy robusztus irányítási keretrendszer szükségességét.

Pro tipp: Hozzon létre egy "red team"-et a szervezetén belül, amelynek feladata az MI adatvédelmi kontrolljainak stressztesztelése. Ennek a csapatnak az a dolga, hogy ellenfélként viselkedjen, folyamatosan új parancsokat fogalmazva meg, hogy megpróbálja rávenni az MI-t érzékeny információk felfedésére. Eredményeik kulcsfontosságúak a védelmi rendszerek megerősítéséhez.

Stratégiai útmutató az adatvédelem-központú AI ügynökök telepítéséhez

Az adatvédelem-központú MI sikeres bevezetése nem csupán technikai, hanem stratégiai kihívás is. A szervezeteknek egyértelmű, végrehajtható útmutatóra van szükségük az elmélettől a megvalósításig. Az alábbi lépések egy magas szintű keretrendszert nyújtanak ehhez az úthoz.

| Lépés | Cselekvés | Kulcsfontosságú cél |

|---|---|---|

| 1. Irányítási Tanács Létrehozása | Hozzon létre egy több szakterületet átfogó csapatot jogi, IT, megfelelőségi és üzleti vezetők bevonásával. | A szervezet hivatalos adatvédelmi irányelveinek és az MI-alkalmazások kockázattűrésének meghatározása. |

| 2. Adatok és Kontextusok Osztályozása | Végezzen alapos auditot az MI által használt összes adatforrásról. Osztályozza az adatokat érzékenységi szint szerint és térképezze fel a felhasználási kontextusokat. | A PrivacyChecker konfigurálásához vagy egy CI-CoT modell képzéséhez szükséges alapvető szabálykönyv létrehozása. |

| 3. Kísérleti Program Reaktív Pajzzsal | Válasszon ki egyetlen, nem kritikus MI-rendszert és implementálja a PrivacyChecker-t. | Gyakorlati tapasztalat szerzése az adatvédelmi kontrollokkal és valós adatok gyűjtése a lehetséges jogsértésekről minimális kockázattal. |

| 4. Hosszú Távú Proaktív Stratégia Kidolgozása | A kísérleti program eredményei alapján különítsen el erőforrásokat egy saját modell finomhangolására a CI-CoT + CI-RL segítségével. | Egy alapvetően biztonságos adatfeldolgozó AI ügynökökből álló központi eszközrendszer kiépítése a nagy téttel bíró alkalmazásokhoz. |

| 5. Folyamatos Monitorozás Bevezetése | Telepítsen eszközöket az összes lekérdezés és MI-válasz naplózására és elemzésére, megjelölve a letiltott vagy adatvédelmi figyelmeztetést generáló eseteket. | A folyamatos auditálás, fenyegetésészlelés és az adatvédelmi keretrendszer folyamatos fejlesztésének lehetővé tétele. |

Ennek az útmutatónak a követése lehetővé teszi a vállalkozások számára, hogy ne csak a szabályozásoknak feleljenek meg, hanem fenntartható versenyelőnyt is kiépítsenek. Az elkövetkező években a bizalom lesz a digitális gazdaság legértékesebb valutája. Azok a cégek fognak győzni és megtartani az ügyfeleik hűségét, amelyek bizonyítani tudják, hogy MI-rendszereiket a felhasználói adatvédelem központi elemeként tervezték. Az az időszak, amikor az adatvédelmet csak egy kipipálandó feladatnak tekintették, lejárt; ma már a megalapozott üzleti stratégia központi pillére és a piaci megkülönböztetés kulcstényezője.

A vállalati automatizálás jövője olyan MI telepítésén múlik, amely nemcsak erős, hanem megbízható is. A fejlett adatvédelmi keretrendszerek integrálásával kiaknázhatja adatai teljes potenciálját, miközben fenntartja a szabályozási megfelelést és az ügyfélbizalmat.

Építse fel biztonságos AI ügynökeit még ma[A cikket az AiSolve MI Tartalomrendszere generálta]

Gyakran Ismételt Kérdések

Mi az a "kontextuális integritás" a mesterséges intelligenciában?

A kontextuális integritás az az elv, hogy az információkat csak a gyűjtésük eredeti kontextusának megfelelő módon szabad felhasználni és megosztani. Egy MI számára ez azt jelenti, hogy például megérti, hogy az alkalmazotti teljesítményadatokat (szakmai kontextus) nem szabad összekeverni a személyes egészségügyi adataikkal (privát kontextus), még ha mindkét adathalmaz elérhető is. Az implicit társadalmi és etikai határok tiszteletben tartásáról van szó, nem csak a technikai adathozzáférési engedélyekről.

Mi a fő különbség a PrivacyChecker és a CI-CoT módszer között?

Az elsődleges különbség a reaktív és proaktív kontroll. A PrivacyChecker egy reaktív "pajzs", amely valós időben ellenőrzi a parancsokat és válaszokat egy szabályrendszer alapján, letiltva a jogsértéseket. Ezt egy meglévő modellhez adják hozzá. A CI-CoT + CI-RL módszer egy proaktív képzési technika, amely alapjaiban tanítja meg a modellt az adatvédelemről való gondolkodásra. A modell megtanulja értelmezni és alkalmazni az adatvédelmi elveket, ahelyett, hogy csak egy külső modul felügyelné.

Hogyan kezdheti el egy kisvállalkozás ezeknek az MI adatvédelmi kontrolloknak az implementálását?

Egy kisvállalkozás számára praktikus első lépés egy reaktív megközelítéssel kezdeni. Ha harmadik féltől származó MI API-kat használnak, implementálhatnak egy PrivacyChecker-hez hasonló megoldást ezen API hívások köré. Ez magában foglalja egy világos, egyszerű adatvédelmi irányelv-készlet meghatározását, amely releváns az üzletük számára – például "soha ne tárolj ügyfél bankkártyaadatokat a chat naplókban". Ez jelentős biztonsági fejlesztést nyújt anélkül, hogy egyedi modell képzésének hatalmas költségeivel járna.

Ezek az adatvédelmi eszközök garantálják az adatszivárgások elleni védelmet?

Nem, nem jelentenek abszolút garanciát. Jelentős előrelépést képviselnek az LLM-ekkel kapcsolatos adatvédelmi kockázatok csökkentésében, de nem tévedhetetlenek. Hatékonyságuk a beállított irányelvek minőségétől és a képzés alaposságától függ. A rosszindulatú szereplők mindig új módszereket fognak keresni az MI-rendszerek becsapására. Ezért ezeket az eszközöket egy átfogó, mélységi védelmi stratégia kritikus rétegének kell tekinteni, amelynek magában kell foglalnia az adattitkosítást, a hozzáférés-szabályozást és a rendszeres biztonsági auditokat is.

Készen állsz a saját weboldaladra?

Ingyenes konzultáció során átbeszéljük, hogyan segíthetünk vállalkozásodnak növekedni egy modern, gyors és konverzióoptimalizált weboldallal. 14 nap alatt kész, 0 Ft induló költséggel.